Beber café es parte del ritual diario de millones de personas. Sin embargo, un estudio reciente ha arrojado una alerta importante para quienes eligen la versión instantánea: podría estar relacionada con un mayor riesgo de pérdida de visión. Investigadores de la Universidad de Medicina de Hubei, en China, encontraron una conexión significativa entre el consumo regular de café instantáneo y el desarrollo de degeneración macular asociada a la edad (DMAE) en su forma seca, una de las principales causas de ceguera parcial en adultos mayores. Continúa leyendo «Tú taza de café instantáneo podría afectar tu visión: lo que revela un estudio reciente»

Etiqueta: visión

El oro como aliado inesperado para recuperar la visión: un avance prometedor desde la Universidad de Brown

La ciencia está llena de giros inesperados, y uno de los más recientes viene desde los laboratorios de la Universidad de Brown, donde un grupo de investigadores ha dado un paso importante en la lucha contra la degeneración macular. El protagonista de esta historia no es un sofisticado robot ni un complicado software, sino el oro, símbolo milenario de riqueza, convertido ahora en herramienta de restauración visual. Continúa leyendo «El oro como aliado inesperado para recuperar la visión: un avance prometedor desde la Universidad de Brown»

El proyecto Prakash y sus avances para entender mejor cómo ven los humanos

Hace poco se dio a conocer un estudio aplicado en pacientes que habían estado ciegos toda su vida y que recuperaron la visión, el cual arrojó resultados que dotan de una nueva perspectiva a la creencia de que los bebés requieren de exposición visual para reconocer el movimiento humano.

Cabe mencionar que la comprensión del lenguaje corporal es un proceso que resulta importante para el desarrollo social del ser humano.

Continúa leyendo «El proyecto Prakash y sus avances para entender mejor cómo ven los humanos»

Un simulador permite averiguar cómo es la vida de personas con problemas graves de visión

En Internet podemos encontrar diferentes proyectos que tienen por objetivo concienciar acerca de un problema o situación determinada. Recientemente nos ha llamado la atención See Now, un detallado simulador que nos permite averiguar cómo es la vida de personas con problemas graves de visión desde el navegador.

Tal y como podéis comprobar en el enlace que os indicamos al final del artículo, See Now cuenta con varios modos de uso distintos que permiten experimentar cómo es el día a día de personas con cataratas, glaucoma y retinopatia. En lugar de basarse en conceptos teóricos, See Now nos pide que introduzcamos una dirección física con la que estemos familiarizados, de forma que podamos comprobar cómo ven la realidad las personas afectadas por estas enfermedades mientras nos movemos por calles que conocemos gracias a la tecnología de Google.

YouTube comienza a experimentar con vídeos con diferentes ángulos de visión

YouTube ha comenzado un nuevo experimento en el que permitirá a los usuarios la posibilidad de seleccionar diferentes ángulos de visión durante la reproducción de aquellos vídeos que lo permitan, siendo en la actualidad el vídeo alojado el canal de la cantante Madilyn Bailey el único que lo permite hasta la fecha. Para ello, el equipo de YouTube ha propuesto a la artista la realización de las pruebas de vídeo de múltiples ángulos para su actuación en el YouTube Music Night, siendo aceptada por la misma, indicando que se siente encantada por ser super activa con su comunidad en línea, sirviendo como manera de poner más libertad en manos de sus espectadores, dándoles la posibilidad de tener una experiencia de visualización más personalizada.

En este aspecto, aquellos YouTubers estadounidenses que también quieran acogerse a las señaladas pruebas, podrán inscribirse en un formulario disponible para tener la posibilidad de ser seleccionados y participar en las mismas con sus canales en YouTube.

Un portavoz de la plataforma de alojamiento de vídeos ha señalado a Techcrunch que este experimento forma parte de los esfuerzos que están llevando a cabo para seguir haciendo experiencias de vídeos más inmersivas e interactivas, aunque también puntualizó que la tecnología que lo posibilita aún no está lista para ser escalada a todos los usuarios. Hay que señalar además que el proceso de creación de vídeos es completamente transparente de cara a los usuarios, quienes tan sólo se dedicarán a seleccionar en cada momento una de las miniaturas disponibles dentro de los propios vídeos para seleccionar un ángulo diferente, casi como su fuese un realizador de televisión.

Si bien existieron otras iniciativas en Internet que ofrecían esta posibilidad, en estos momentos no han despegado o directamente han desaparecido, pero no cabe duda de que YouTube si podría dar un buen empujón a esta experiencia inmersiva gracias a los recursos que dispone y a la comunidad de usuarios que forma parte de su plataforma.

SimilarWeb lanza Dive In, para ofrecer una visión general del uso de aplicaciones móviles a sus desarrolladores

SimilarWeb es una de las muchas herramientas que pueden emplear los profesionales SEO para conocer y analizar la información que muestran sitios web a los propios rastreadores, como os comentamos hace dos años. En pleno auge de las aplicaciones y dispositivos móviles, esta semana han lanzado Dive in, una aplicación móvil que ofrecerá a los desarrolladores de aplicaciones móviles, comenzando por las aplicaciones Android en Estados Unidos y Reino Unido, una visión de cómo se están usando las mismas, conociendo aspectos como la cantidad de usuarios que hacen uno de las mismas hasta la duración media de las sesiones de uso, entre otros.

En su anuncio consideran este lanzamiento como un hito importante como parte del nuevo conjunto de ideas para la economía de las aplicaciones móviles, enfocándose en lo que sucede en las aplicaciones una vez sean instaladas en los dispositivos de los respectivos usuarios, con el objetivo de ofrecer una imagen más completa posible de su mundo digital.

Invitan a aquellos que pudieran estar interesados a que se registren para obtener más información acerca de esta aplicación, anunciando además el lanzamiento de un ranking sobre las aplicaciones más utilizadas como parte de sus nuevos puntos de vista, en el que publicarán diferentes ranking a través del propio blog de la compañía, comenzando por el ranking de uso de las aplicaciones gratuitas, cuya infografía también se encuentra disponible en el mismo anuncio.

Google actualiza Drive y Docs con mejoras de accesibilidad para usuarios con problemas de visión

Google, bajo su compromiso con una web totalmente accesible, y teniendo en cuenta a aquellos usuarios invidentes o con baja visión, acaba de actualizar Drive así como en todas las herramientas de edición: Docs, Sheets, Slides, Drawings, y Forms, con una serie de mejoras pensadas específicamente en su accesibilidad, comenzando con las mejoras en el soporte para los lectores de pantallas en Drive y Docs, señalando que ahora es más fácil hacer uso de ellos, contando con una mejor verbalización de texto a voz y mejoras en la navegación por teclado.

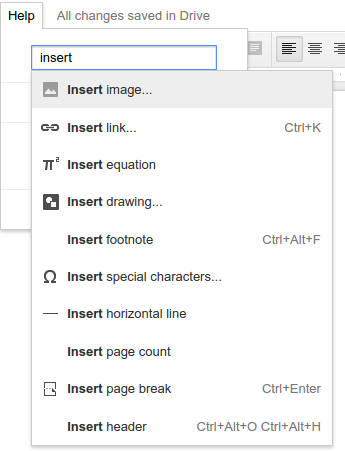

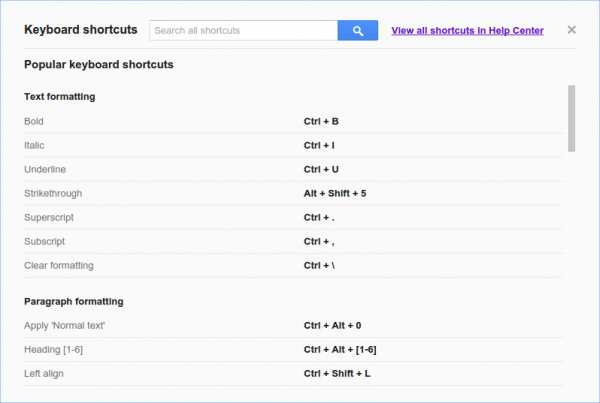

Otros cambios incluyen soporte para las descripciones de las imágenes en Docs a través del texto alt, soporte mejorado para el uso de teclados para editar gráficas y tablas dinámicas en Sheets, mejoras adicionales para los lectores de pantalla específicamente para Docs, Sheets y Slides, incluyendo soporte para sugerencias de ortografía, comentarios e historial de revisiones, y también se añade la posibilidad de realizar búsquedas rápidas de menús y realizar acciones en Docs, Slides y Draw, que también llegarán próximamente a Sheets y Forms, incluso si no se conocen las secuencias de teclado de las acciones.

En el aspecto colaborativo, los lectores de pantalla avisarán cuando otros usuarios entran y salen de los documentos en Docs, Sheets, Slides y Drawings, permitiendo saber con quienes se está trabajando en un mismo documento.

En lo que respecta a las pantallas Braille, Google señala que ahora se puede utilizar para leer y escribir textos en Docs, Slides y Drawings. Con el soporte de Braille, la configuración del lector de pantalla permitirá el seguimiento automático del eco del carácter. También se reduce bastante el retraso entre el momento en el que se pulsa una tecla y la misma se anuncia a través del lector de pantalla, y también hay mejoras en los anuncios de puntuación y espacios en blanco.

Google ha puesto a disposición una serie de guías para aquellos usuarios que utilicen por primera vez un lector de pantalla o una pantalla Braille. Por otro lado, también facilita acceder a la opción de ayuda del menú en cualquier momento sin necesidad de interrumpir su trabajo, o utilizar el diálogo de ayuda de los atajos actualizados para buscar fácilmente a través de atajos de teclado, si no te acuerdas de ellos.

Por último, Google añade soporte de asistencia telefónica para preguntas de accesibilidad en Google Drive. Respecto a su compromiso con la accesibilidad en la web, acaban de lanzar un nuevo sitio en el que ofrece más información al respecto: www.google.com/accessibility.

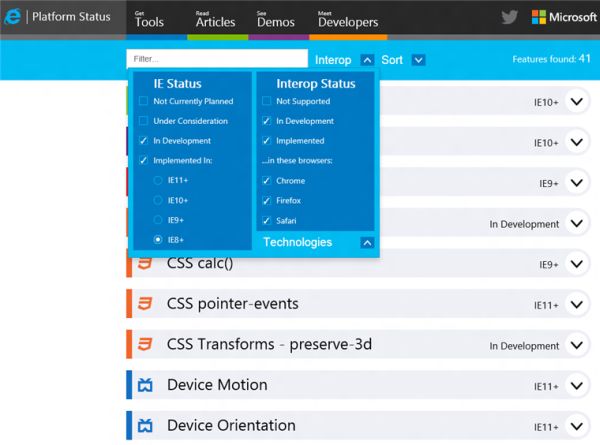

Microsoft señala algunas de las nuevas características para la próxima versión de IE

En el //Build 2014, se lanzó la beta de status.modern.ie, un espacio web que posibilita a los desarrolladores conocer las tecnologías que actualmente soporta Internet Explorer así como aquellas otras tecnologías que se van a implementar en futuras versiones. Hoy anuncian desde el blog oficial de Internet Explorer la «eliminación de la etiqueta beta» y la incorporación de nuevas características, siendo éstas su disponibilidad como fuente abierta a través de GitHub bajo licencia Apache v2, permitiendo a los desarrolladores contribuir al proyecto, mejoras respecto a las búsquedas y filtrado, ofrecimiento de enlaces profundos a características que se desean compartir con los demás, además de las mejoras del soporte móvil y del rendimiento.

Además, también se señala a un conjunto de características que están en desarrollo para que esté disponible en la próxima versión de Internet Explorer, siendo éstas el soporte para Audio Web, captura de medios y difusión, ES6 Promises y HTTP/2. A este respecto, no se trata de una lista completa sino más bien de características en la que sus desarrolladores están trabajando en este momento, y aprovecha el anuncio para ofrecer más acerca de la visión y las prioridades del equipo de la plataforma de Internet Explorer que están trabajando en dotar de capacidades HTML5 al propio navegador.

La visión y prioridades la resumen en la siguiente frase:

La Web debe trabajar sólo para todos – usuarios, desarrolladores y empresas.

Las prioridades más importantes que permitirá lograr la visión que pretende ofrecer la plataforma de Internet Explorer son: que sus actuales usuarios utilicen la última versión del navegador, la seguridad, y la interoperabilidad y compatibilidad.

Al final del anuncio señalan que en los próximos meses compartirán más acerca de como planean hacer esas prioridades en una realidad.

Google está desarrollando tabletas con capacidades de visión avanzadas

A estas alturas ya no cabe duda alguna de que los dispositivos móviles han venido para quedarse, aunque si que puede haber dudas respecto a las posibilidades que estos dispositivos puedan brindar en un futuro a los usuarios. En este sentido, nos encontramos con un artículo de Wall Street Journal en el informan que el gigante de las búsquedas, Google, está desarrollando una nueva tableta de última generación, la cual contará con capacidades avanzadas de visión para dispositivos móviles, con las cuales sigue experimentando. La idea es producir un total de 4.000 unidades del prototipo de tableta para el próximo mes, y forma parte del esfuerzo de investigación que está desarrollando Google bajo el Proyecto Tango, según una fuente cercana.

La tableta contará con una pantalla de 7 pulgadas y dispondrá de dos cámaras traseras, sensores infrarrojos de profundidad, así como software avanzado para la captura de imágenes precisas en tres dimensiones de los objetos. Su lanzamiento podría ser antes de la conferencia anual, que se celebrará a finales del mes de junio.

Dentro del Proyecto Tango también existe un prototipo de teléfono móvil inteligente, que se lanzó en el pasado mes de Febrero, y que cuenta con sensores similares y está diseñada para crear una especia de mapa tridimensional del entorno del propio usuario. Con ello, la tecnología incorporada en el propio dispositivo permitiría mejorar la navegación en interiores para los discapacitados visuales, direcciones paso a paso dentro de los establecimientos, así como videojuegos más inmersivos, según palabras de la propia compañía.

Google no se encuentra sólo en la investigación y desarrollo de tecnologías avanzadas de visión por ordenador, ya que Facebook también se encuentra dentro de este sector gracias a la adquisición de Oculus VR, el fabricante de casos futuristas de realidad virtual. Estas tecnologías ofrecen mucho más que las habituales pantallas 3D, que han existido durante años, según señala Rajeev Chand, jefe de investigación de Rutberg & Co

El destino de las tabletas que Google está desarrollando iría a manos de los desarrolladores, para que éstos desarrollen soluciones prácticas que puedan ser útiles para los usuarios. Con ello, según pretende Google, los desarrolladores podrían experimentar con estos dispositivos futuristas para que puedan crear nuevas aplicaciones que atraigan a más usuarios.

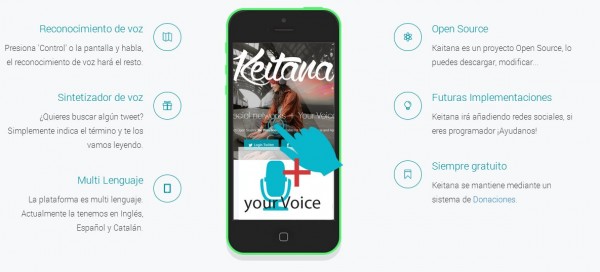

keitana, una solución para ayudar a usar las redes sociales a personas con discapacidad visual

Ayer mismo estuve leyendo este artículo de la ONCE (Organización Nacional de Ciegos Españoles) titulado «Las personas con discapacidad también quieren usar las redes sociales«. Se trata de una lista de eventos en los que quieren hablar sobre la falta de accesibilidad de las redes sociales, proponiendo soluciones prácticas.

Poco después nos presentan un proyecto relacionado directamente con este tema: Keitana (keitana.com), plataforma que puede permitir que las personas con discapacidad visual puedan usar las redes sociales de forma sencilla usando la voz.

[…] por ejemplo para mandar un tweet sólo tendrías que decir ‘publicar tweet’ […] . Además también podría buscar mensajes y el sintetizador de voz se los leería.

Han programado el sistema con los últimos estándares de reconocimiento de voz y sintetizador de voz de forma que los usuarios puedan incorporar el código en sus proyectos y así hacer Internet un poco más accesible. Está creado en HTML5, por lo que funciona en cualquier plataforma, disponible en castellano, inglés y catalán y compatible con Windows, Linux, Mac, android y iOs. Es un proyecto opensource (código libre), por lo que puede bajarse e implementarse en nuestra aplicación, así como mejorarse o añadir funcionalidades colaborando con la idea.

No es necesario instalar programas especiales, sólo la última versión del Chrome, aunque de momento está en versión beta. Podéis bajar el código a partir del enlace de la parte inferior de la página y probarlo al realizar la identificación vía twitter, siendo necesario pulsar la tecla ctrl mientras hablamos, y soltarla cuando termine.