OpenAI anunció una actualización en ChatGPT y DALL-E 3, sus herramientas de generación de texto e imágenes basadas en inteligencia artificial (IA), introduciendo un sistema de etiquetado de metadatos para identificar claramente el contenido generado por IA. Este anuncio se produjo poco después de que Meta revelara una iniciativa similar para sus propias imágenes generadas por IA a través de Imagine, disponible en plataformas como Instagram y Facebook.

La medida busca abordar la creciente preocupación por la autenticidad del contenido en la era digital, especialmente en un momento donde la desinformación y los deepfakes se han convertido en herramientas poderosas para manipular percepciones y realidades.

Transparencia en la generación de contenido digital

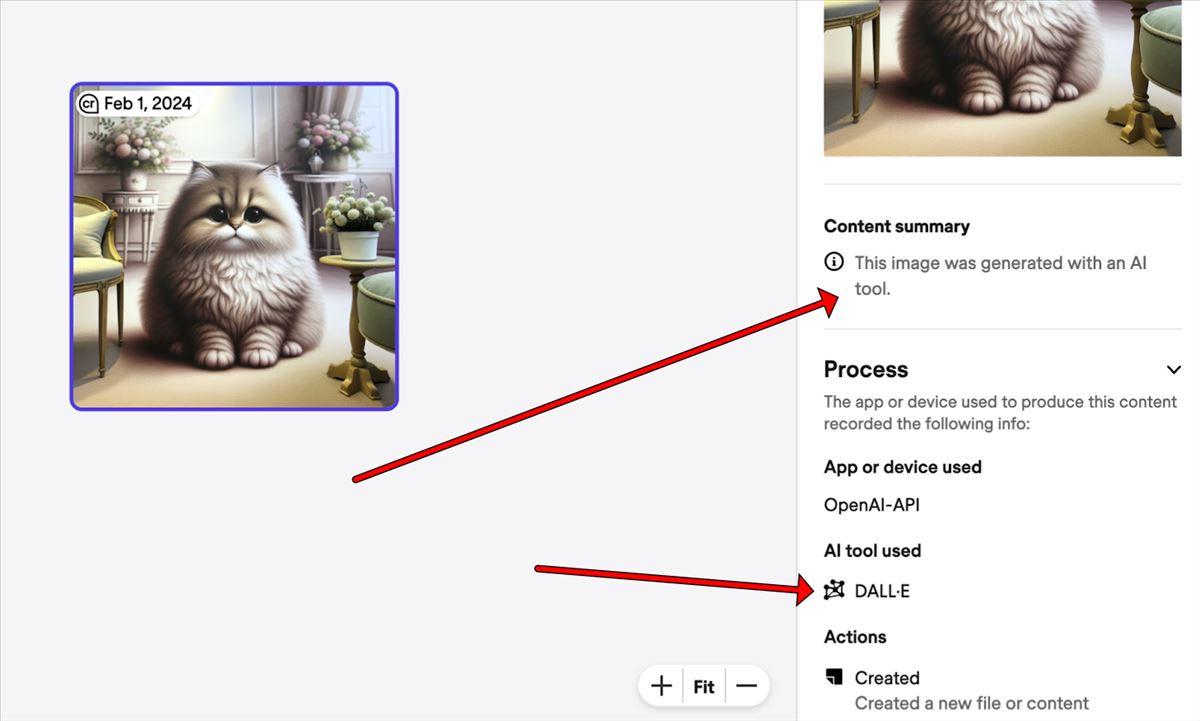

OpenAI ha implementado metadatos usando las especificaciones de la Coalición para la Provenancia y Autenticidad del Contenido (C2PA), un esfuerzo conjunto liderado por importantes entidades tecnológicas y mediáticas. Este paso refleja un compromiso con la creación de contenido digital responsable y facilita a las plataformas y distribuidores de contenido la identificación de imágenes generadas por IA, aunque sigue siendo imposible distinguirlas si se hace una captura de pantalla en lugar de una descarga del resultado.

Así es, el reto de asegurar la autenticidad del contenido en línea es complejo, especialmente cuando consideramos lo fácil que puede ser alterar o eliminar metadatos. OpenAI admite abiertamente este desafío, señalando que, aunque los metadatos son un paso importante, no son una solución definitiva. Las plataformas de redes sociales, por ejemplo, a menudo eliminan estos datos al subir imágenes, y acciones tan simples como tomar una captura de pantalla pueden deshacerse de esta información crucial.

De momento ya han puesto un enlace a contentcredentials.org/verify para que cualquiera pueda verificar el contenido.

Comparativa con la iniciativa de Meta

Mientras OpenAI opta por una solución más técnica y menos visible para el usuario promedio, Meta ha tomado un camino distinto al presentar un sistema de etiquetado visible, incorporando incluso emojis para señalar el contenido generado por IA. Aunque ambos enfoques se basan en la normativa C2PA, la ejecución varía significativamente, reflejando distintas filosofías sobre cómo abordar la transparencia y la autenticidad en la era digital.

«Manchar» la imagen con elementos externos es una solución al problema de los metadatos que desaparecen, por supuesto, pero igual inutilizan la herramienta, acabando con el modelo de negocio.

Desde mi perspectiva, la decisión de OpenAI de implementar un sistema de etiquetado de metadatos es un paso adelante hacia un entorno digital más transparente, de eso no hay duda. Sin embargo, es crucial reconocer las limitaciones inherentes a esta solución. La tecnología continúa avanzando a un ritmo vertiginoso, y con ella, la sofisticación de las herramientas de manipulación digital. He observado cómo la facilidad con la que se puede crear y distribuir contenido falso o manipulado ha crecido exponencialmente, lo que hace aún más importante el desarrollo de estándares y herramientas que promuevan la autenticidad del contenido.

Iniciativas como las de OpenAI y Meta son esenciales para mantener una base de confianza en el contenido que consumimos diariamente, y como sociedad, debemos continuar explorando y apoyando estas iniciativas, pero siempre con un ojo crítico hacia sus limitaciones y el otro hacia las posibilidades que abren para un futuro digital más transparente y auténtico.