Hasta ahora, Google Chat tenía una paradoja típica de las herramientas de trabajo: es donde ocurren las cosas con más velocidad, pero también donde más fácil se pierden. Decisiones rápidas, nombres de responsables, fechas que cambian sobre la marcha, enlaces compartidos a toda prisa… todo eso suele quedarse en el flujo de mensajes, sin llegar… Continúa leyendo »

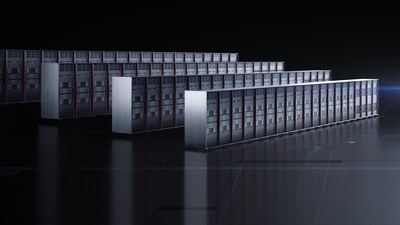

Huawei presenta su cartera SuperPoD en MWC Barcelona 2026: Atlas 950, TaiShan 950 y una apuesta por la colaboración abierta

La inteligencia artificial está entrando en una fase en la que los modelos ya no se cuentan en millones o miles de millones de parámetros, sino en escalas de billones de parámetros, con sistemas cada vez más orientados a agentes que ejecutan tareas completas y se integran en procesos reales de empresas. En ese escenario, el “músculo” que pide la IA no es solo más potencia bruta: también exige baja latencia, uso eficiente del hardware y la capacidad de escalar sin que la infraestructura se convierta en un cuello de botella.

El problema es que crecer “en horizontal” —sumar más nodos a un clúster tradicional— no siempre trae mejoras lineales. A partir de cierto tamaño, muchos entornos empiezan a comportarse como una autopista a la que se le añaden carriles sin mejorar las entradas y salidas: hay más asfalto, sí, pero también más atascos. En entrenamiento de IA, esos “atascos” aparecen cuando la comunicación entre aceleradores se vuelve costosa, baja la utilización del clúster y aumentan las interrupciones durante el entrenamiento. Esto es especialmente delicado cuando el coste de parar y reanudar implica perder tiempo de cómputo muy caro y ralentizar la iteración del modelo.

Con ese telón de fondo, Huawei llevó a MWC Barcelona 2026 su visión de cómo empaquetar computación a gran escala: una cartera SuperPoD que agrupa hardware, interconexión y una forma de presentar el conjunto como si fuese una sola máquina lógica. Continúa leyendo «Huawei presenta su cartera SuperPoD en MWC Barcelona 2026: Atlas 950, TaiShan 950 y una apuesta por la colaboración abierta»