El teléfono de OpenAI ya no es solo un rumor de cadena de suministro: el analista Ming-Chi Kuo, el más fiable del sector para hardware Apple y ahora también para los nuevos entrantes en hardware de IA, ha publicado este 5 de mayo una actualización de sus previsiones que adelanta la producción en masa al primer semestre de 2027. Hace apenas dos semanas Kuo había apuntado a 2028; el cambio en un mes es significativo. Lo cubre The Verge con el análisis del propio Kuo en X. Continúa leyendo «El teléfono de OpenAI se acelera: producción en masa en el primer semestre de 2027, chip MediaTek personalizado y 30 millones de unidades proyectadas»

Google, Microsoft y xAI acuerdan dar al gobierno de EE.UU. acceso temprano a sus modelos de IA con salvaguardas reducidas para evaluación de seguridad nacional

Google, Microsoft y xAI han firmado acuerdos con el Departamento de Comercio de Estados Unidos para proporcionar al gobierno acceso anticipado a sus modelos de IA. Lo publica Igor Bonifacic en Engadget este 5 de mayo a partir de información de The Wall Street Journal. El organismo receptor es el Centro para Estándares e Innovación en IA (CAISI), que evaluará los nuevos modelos que cada empresa desarrolle antes de que se lancen públicamente. Continúa leyendo «Google, Microsoft y xAI acuerdan dar al gobierno de EE.UU. acceso temprano a sus modelos de IA con salvaguardas reducidas para evaluación de seguridad nacional»

Instagram empieza a probar etiquetas voluntarias de «creador de IA»: el problema es que son opcionales

Instagram está probando una nueva etiqueta de perfil que permitirá a los creadores identificarse voluntariamente como «AI creator»: cuentas cuyo contenido es generado o modificado con inteligencia artificial. Lo publica Karissa Bell en Engadget este 4 de mayo. La etiqueta aparecerá tanto en el perfil del creador como junto a sus publicaciones y Reels. El texto que verá el usuario es: «Este perfil publica contenido que fue generado o modificado con IA.» Continúa leyendo «Instagram empieza a probar etiquetas voluntarias de «creador de IA»: el problema es que son opcionales»

Google confirma que pondrá anuncios en Gemini: el chatbot de IA más usado ya tiene fecha con la publicidad

Google ha dado un giro de 180 grados respecto a su posición de diciembre de 2025. El Chief Business Officer de Google, Philip Schindler, confirmó durante la conferencia de resultados del primer trimestre de abril de 2026 que la compañía está explorando cómo integrar publicidad en Gemini. Lo publica Paulo Montenegro en Ubergizmo este 4 de mayo. Hace apenas cinco meses, el directivo de IA de Google Demis Hassabis decía en Davos que Gemini seguiría sin anuncios «de momento». El «de momento» acaba de llegar. Continúa leyendo «Google confirma que pondrá anuncios en Gemini: el chatbot de IA más usado ya tiene fecha con la publicidad»

Microsoft Copilot supera los 20 millones de usuarios de pago y ya lo usan tanto como Outlook: el asistente de IA empresarial más extendido del mundo da un salto del 33% en cuatro meses

Microsoft tiene más de 20 millones de usuarios empresariales pagando por Copilot, anunció el CEO Satya Nadella la semana pasada. Lo publica Viktor Eriksson en Computerworld este 4 de mayo a partir de las declaraciones de Nadella recogidas por TechCrunch. La cifra supone un crecimiento del 33% respecto a los 15 millones que la compañía comunicaba en enero de 2026, y consolida a Copilot como el asistente de IA empresarial de pago más extendido del planeta. Continúa leyendo «Microsoft Copilot supera los 20 millones de usuarios de pago y ya lo usan tanto como Outlook: el asistente de IA empresarial más extendido del mundo da un salto del 33% en cuatro meses»

X cierra Communities y en su lugar llega Acorn: el sustituto descentralizado sobre Bluesky que pone el control en manos del creador

X ha cerrado su función Communities —los grupos temáticos que permitían a usuarios crear y gestionar comunidades dentro de la plataforma— por escaso uso y exceso de spam. Y con ese cierre, decenas de comunidades han tenido que buscar un nuevo hogar. Esta semana debuta Acorn, una plataforma desarrollada por Blacksky que permite a organizaciones y creadores construir sus propias comunidades en el AT Protocol, la misma tecnología descentralizada sobre la que funciona Bluesky. Lo publica Sarah Perez en TechCrunch este 4 de mayo.

Acorn es la respuesta más estructurada hasta ahora a la pregunta que flota desde que Elon Musk compró Twitter en 2022: ¿puede una comunidad construir su espacio online sin depender de las decisiones de una empresa cuyo objetivo primario no es el bienestar de esa comunidad? Continúa leyendo «X cierra Communities y en su lugar llega Acorn: el sustituto descentralizado sobre Bluesky que pone el control en manos del creador»

Anthropic y OpenAI lanzan joint ventures empresariales en el mismo día: la carrera por el despliegue corporativo de IA entra en una nueva fase

Este lunes, Anthropic y OpenAI anunciaron casi simultáneamente la creación de sendas sociedades de capital mixto orientadas a servicios de IA empresarial. No es casualidad que ocurra el mismo día. Lo cuenta Russell Brandom en TechCrunch. Los dos principales laboratorios de IA del mundo están usando el mismo mecanismo —un joint venture con capital privado y fondos alternativos— para resolver el mismo problema: llevar sus modelos a empresas medianas y grandes de forma no solo como API, sino como servicio completo de despliegue e integración. Continúa leyendo «Anthropic y OpenAI lanzan joint ventures empresariales en el mismo día: la carrera por el despliegue corporativo de IA entra en una nueva fase»

Dos tiroteos, dos conversaciones con ChatGPT: ¿qué responsabilidad tiene OpenAI cuando su chatbot ayuda a planear un ataque?

ChatGPT no solo es el asistente de tareas del que se habla en las presentaciones corporativas. Para algunas personas en momentos de crisis es también confidente, consejero y, en los dos casos que acaban de hacerse públicos, aparente facilitador. Lo analiza Amparo Babiloni en Xataka este 4 de mayo, a partir de una investigación del Wall Street Journal. Dos tiroteos en dos países distintos tienen en común una conversación previa entre el atacante y ChatGPT. La pregunta que nadie ha respondido con claridad es: ¿cuándo deben las empresas de IA avisar a las autoridades? Continúa leyendo «Dos tiroteos, dos conversaciones con ChatGPT: ¿qué responsabilidad tiene OpenAI cuando su chatbot ayuda a planear un ataque?»

El X-59 de la NASA supera sus primeras maniobras avanzadas: el avión silencioso que quiere devolver el vuelo supersónico sobre tierra lleva un año en el aire

La NASA ha publicado imágenes del X-59, su avión experimental de vuelo supersónico silencioso, realizando una serie de maniobras de prueba sobre el desierto de Mojave en California el pasado 14 de abril. Lo publica Passant Rabie en Gizmodo este 4 de mayo. El X-59 lleva en el aire desde el 28 de octubre de 2025, cuando completó su vuelo inaugural, y cada sesión de prueba lleva a la aeronave más cerca del umbral supersónico. El objetivo no es hacer historia con la velocidad, sino hacer historia con el silencio. Continúa leyendo «El X-59 de la NASA supera sus primeras maniobras avanzadas: el avión silencioso que quiere devolver el vuelo supersónico sobre tierra lleva un año en el aire»

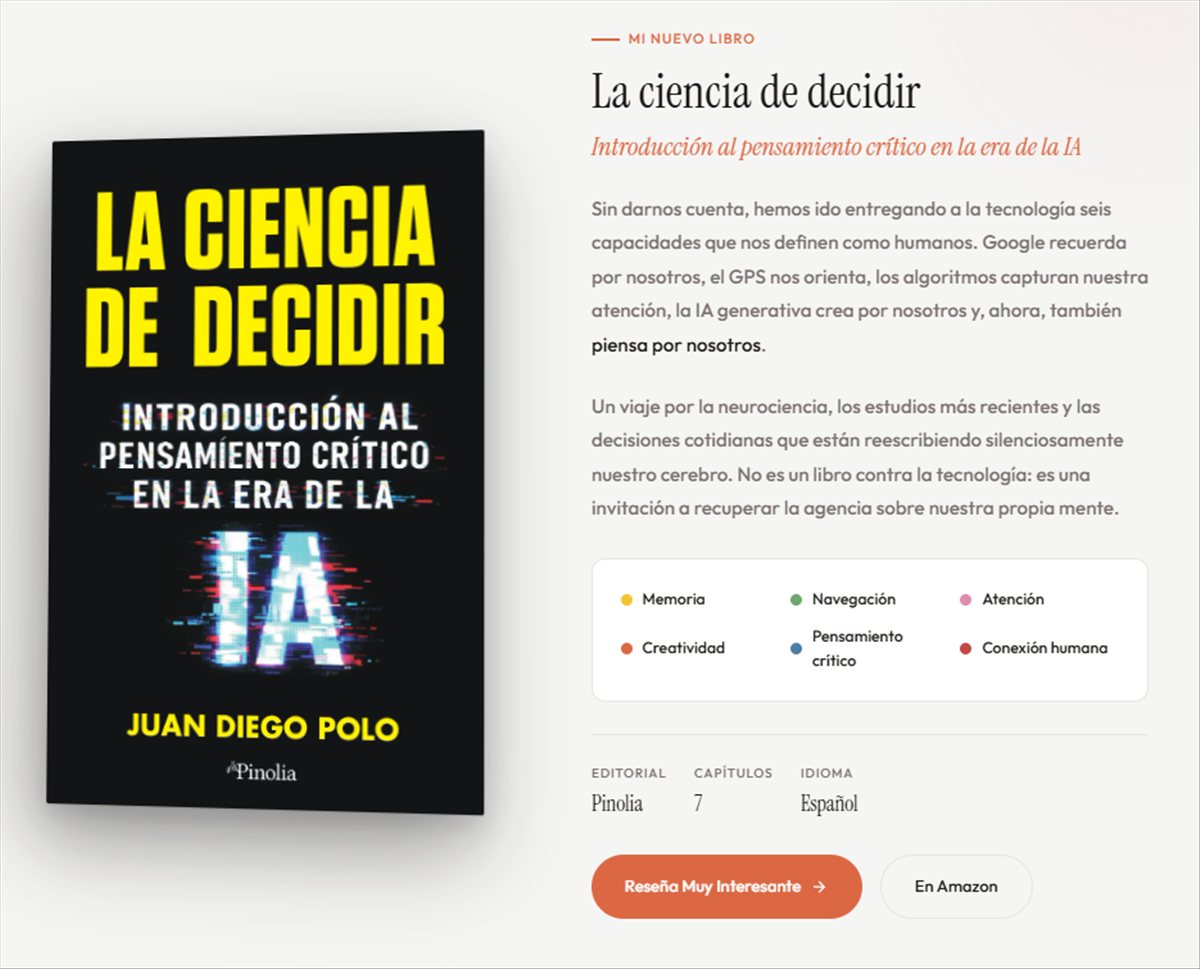

La ciencia de decidir: el libro sobre lo que ya hemos cedido a la tecnología

Santiago Campillo Brocal, biólogo y director de Muy Interesante Digital, ha publicado este martes 5 de mayo una reseña de mi libro La ciencia de decidir. Introducción al pensamiento crítico en la era de la IA, editado por Pinolia. La pieza no se queda en el resumen amable: rescata la idea central del libro y la condensa en una frase que sintetiza meses de trabajo mejor de lo que yo había sabido: «una herramienta que responde demasiado bien puede producir un usuario que pregunta cada vez peor». El libro lleva en mi cabeza desde finales de 2024, cuando vi a treinta estudiantes resolver en doce minutos un ejercicio que antes les costaba una tarde entera, y no supieron explicarme cómo lo habían resuelto. Esa es la historia que arranca el libro y la que justifica la reseña.

Continúa leyendo «La ciencia de decidir: el libro sobre lo que ya hemos cedido a la tecnología»