Un jurado de Nuevo México ha dictaminado que Meta violó la ley de protección al consumidor del estado al ocultar lo que sabía sobre la explotación sexual infantil en Facebook e Instagram y sobre el impacto de sus plataformas en la salud mental de los menores. La multa: 375 millones de dólares en sanciones civiles,… Continúa leyendo »

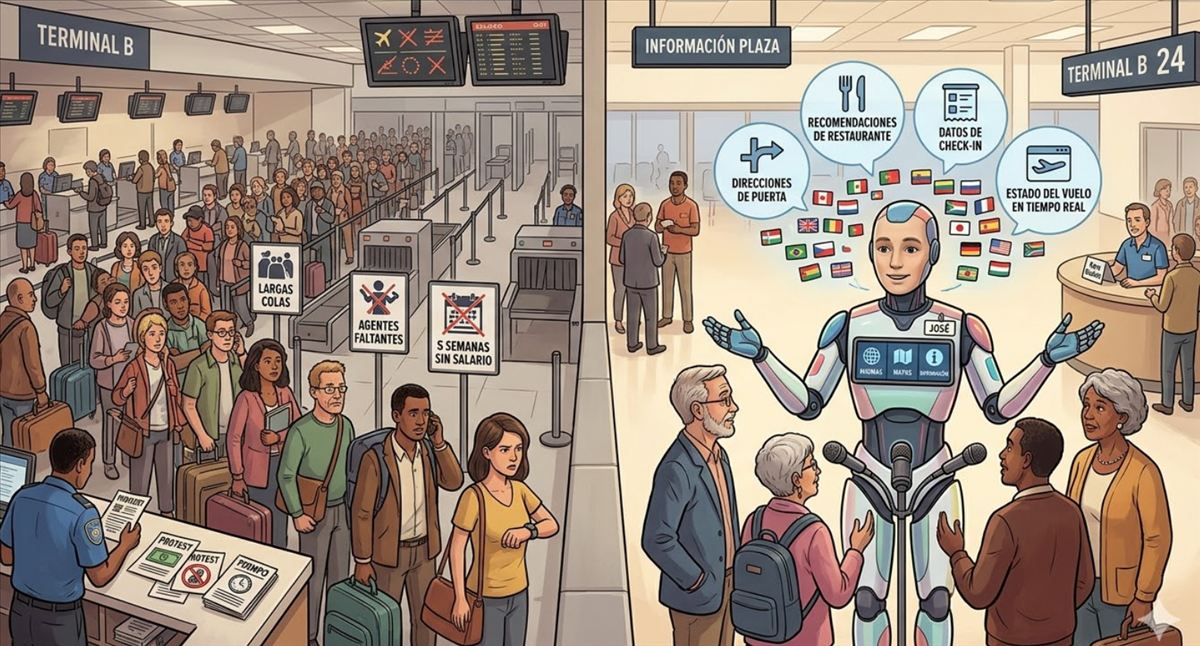

Un robot humanoide llamado José atiende a los pasajeros del aeropuerto de San José en plena crisis de la TSA

Mientras los aeropuertos de Estados Unidos lidian con colas kilométricas por la crisis de la TSA (agentes sin cobrar, despliegue de ICE, 400 dimisiones), el aeropuerto de San José Mineta ha contratado a su empleado más inusual: un robot humanoide llamado José, desarrollado por la startup local IntBot, que recibe a los pasajeros, responde preguntas en más de 50 idiomas y proporciona información en tiempo real sobre la terminal. Continúa leyendo «Un robot humanoide llamado José atiende a los pasajeros del aeropuerto de San José en plena crisis de la TSA»