Netflix y Ubisoft han confirmado que la serie de acción real de Assassin’s Creed se ambientará en la Roma del año 64 d.C. y que ya ha comenzado el rodaje en los estudios de Cinecittà, en Roma. La producción, dirigida por Johan Renck (Chernobyl) y con Roberto Patino (Westworld) y David Wiener (Halo, The Killing)… Continúa leyendo »

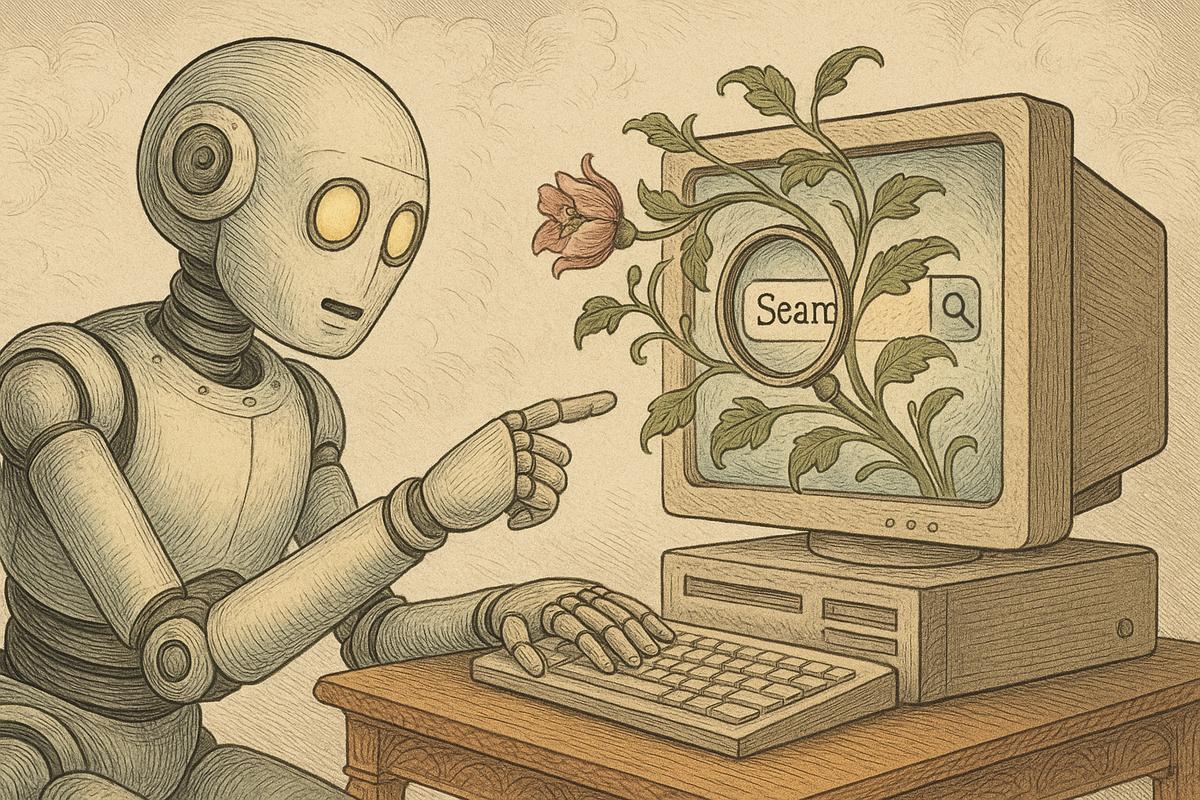

Google está reescribiendo titulares de noticias con IA en los resultados de búsqueda (y los medios están furiosos)

Google ha confirmado que está probando titulares generados por inteligencia artificial en sus resultados de búsqueda tradicionales —los clásicos «diez enlaces azules»—, sustituyendo los titulares originales escritos por periodistas por versiones creadas por IA. El experimento, destapado por The Verge, ha provocado una reacción furibunda de medios y profesionales del SEO, que ven en la práctica una violación del contrato implícito que sustentaba la relación entre Google y los editores desde hace más de 25 años: el contenido que aparece en los resultados de búsqueda refleja lo que el editor publicó.

Sean Hollister, editor senior de The Verge, descubrió que Google había reducido su titular «I used the ‘cheat on everything’ AI tool and it didn’t help me cheat on anything» a solo cinco palabras: «‘Cheat on everything’ AI tool». El resultado: parecía que The Verge estaba recomendando un producto que en realidad desaconsejaba. Otro titular fue reescrito como «Copilot Changes: Marketing Teams at it Again», una frase que nunca apareció en el artículo original.

Hollister lo comparó con «una librería que arranca las portadas de los libros que exhibe y les cambia los títulos». Continúa leyendo «Google está reescribiendo titulares de noticias con IA en los resultados de búsqueda (y los medios están furiosos)»