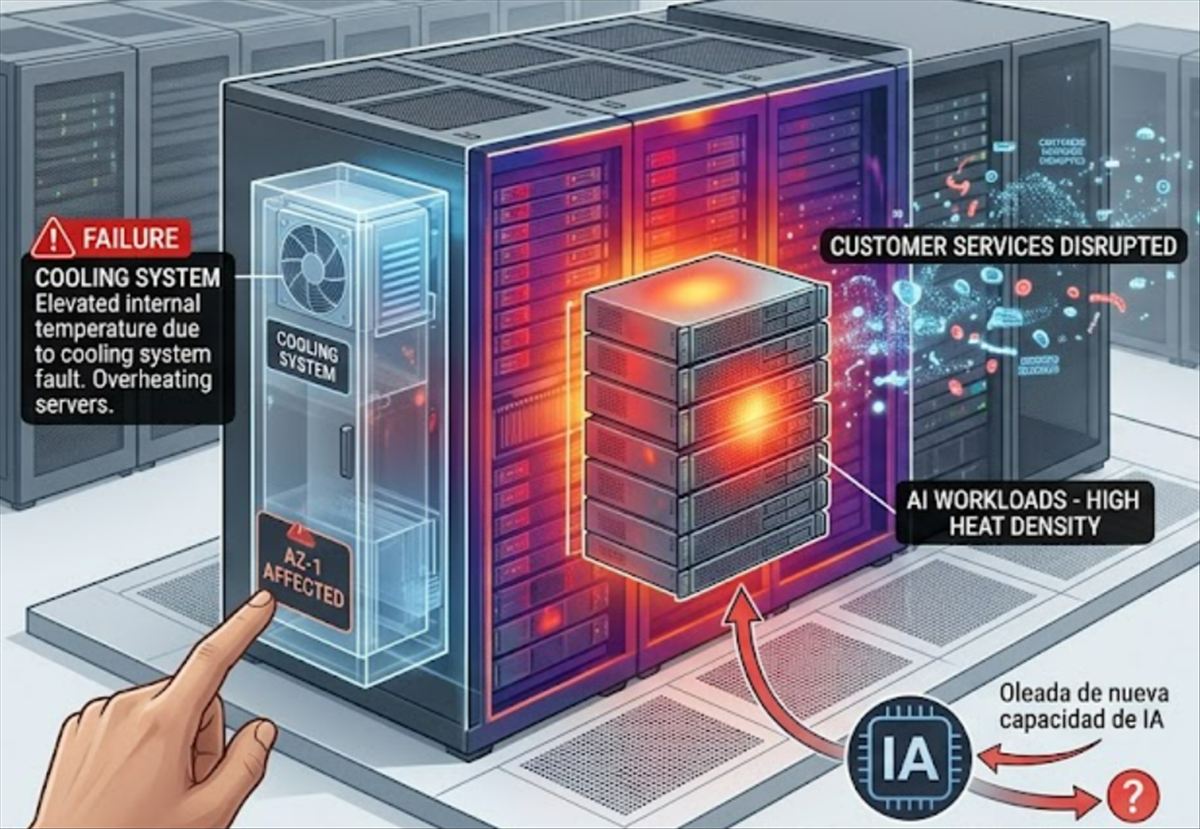

El 8 de mayo, Amazon Web Services reportó que uno de sus centros de datos en el norte de Virginia —la región US-East-1, la más antigua y concentrada de AWS— sufrió temperaturas internas elevadas causadas por un fallo en el sistema de refrigeración. El resultado: servicios de clientes interrumpidos, Coinbase fuera de línea durante varias… Continúa leyendo »

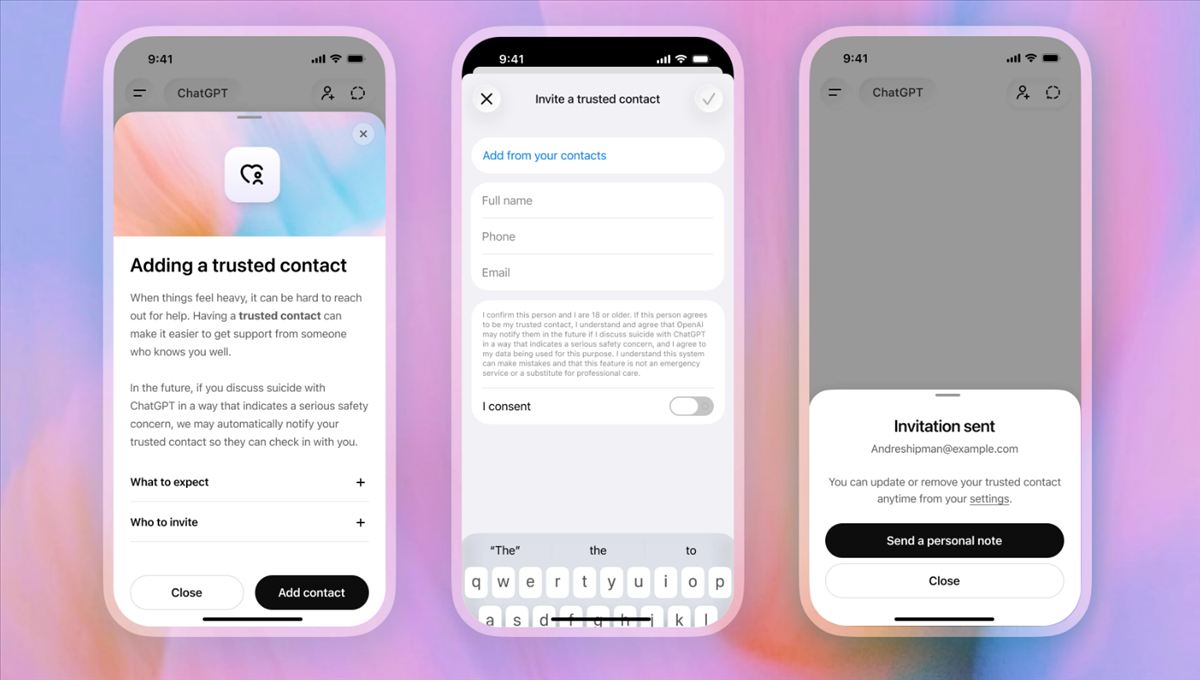

OpenAI añade «Trusted Contact» a ChatGPT: un contacto de confianza que recibe una alerta si la IA detecta riesgo de autolesión

OpenAI anunció el 7 de mayo una nueva función de seguridad en ChatGPT llamada Trusted Contact (Contacto de Confianza): un sistema opcional que permite a los usuarios adultos designar a una persona de confianza que recibirá una alerta breve si el sistema detecta una conversación con indicios de riesgo de autolesión o suicidio. Lo publica TechCrunch. La función está disponible desde el 7 de mayo para usuarios de 18 años o más en todo el mundo (19 o más en Corea del Sur). Continúa leyendo «OpenAI añade «Trusted Contact» a ChatGPT: un contacto de confianza que recibe una alerta si la IA detecta riesgo de autolesión»