Durante décadas, la Luna se ha descrito como un mundo geológicamente “tranquilo” si se compara con la Tierra. Ese retrato sigue siendo útil para entender sus grandes rasgos, pero empieza a quedarse corto cuando bajamos la escala y miramos con lupa. Un equipo del Center for Earth and Planetary Studies del Museo Nacional del Aire… Continúa leyendo »

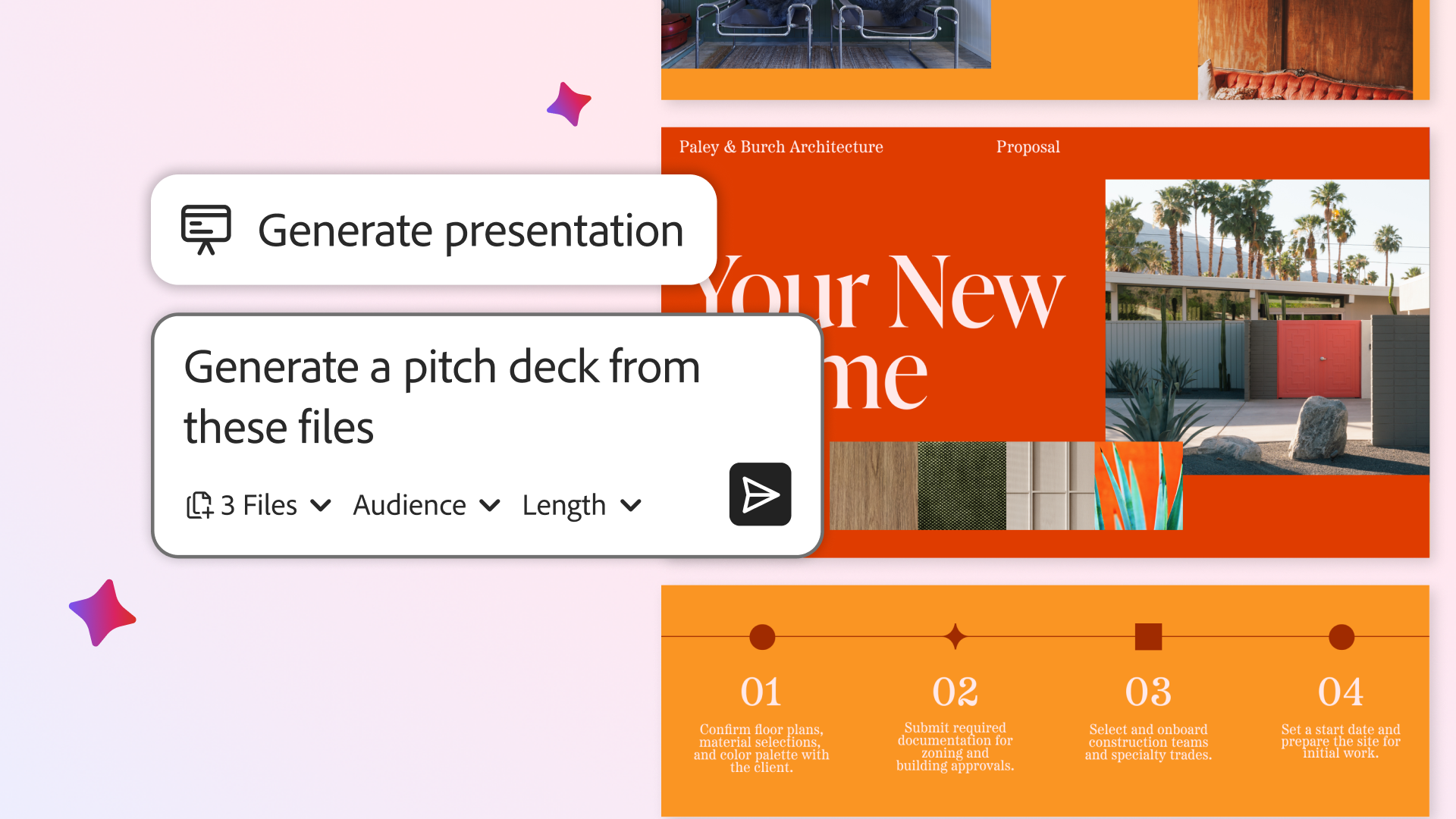

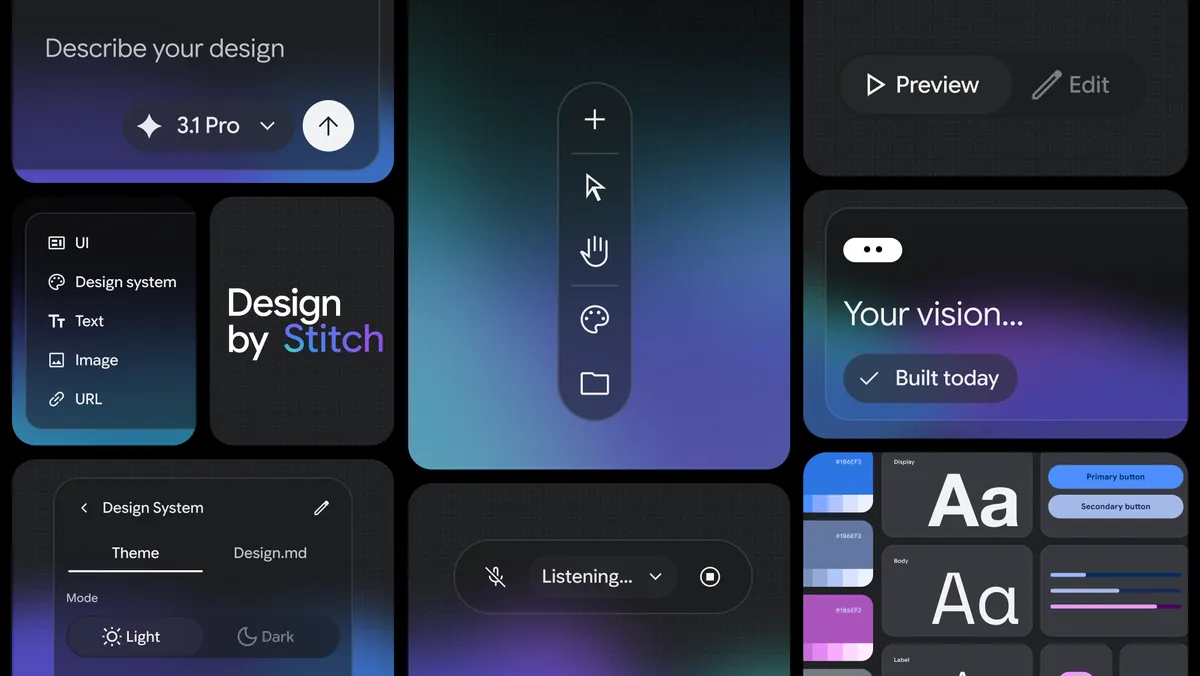

Las funciones de Gemini en Google Workspace que realmente merece la pena usar (y las que puedes ignorar)

Google lleva meses inyectando Gemini en cada rincón de Workspace: Docs, Gmail, Sheets, Slides, Meet, Drive, Calendar, Chat, Vids y Forms. Con tantas actualizaciones simultáneas, la pregunta relevante no es qué puede hacer Gemini, sino qué merece realmente tu atención en el trabajo diario. Tras revisar las funciones que Google ha desplegado recientemente, aquí va un mapa honesto de lo que funciona, lo que promete y lo que puedes ignorar sin remordimientos. Continúa leyendo «Las funciones de Gemini en Google Workspace que realmente merece la pena usar (y las que puedes ignorar)»