En una nave de pruebas en superficie, CERN ha puesto en marcha un proceso que suena simple y es todo lo contrario: enfriar hasta 1,9 kelvin (-271,3 °C) una instalación de 95 metros que reproduce, a escala real, cómo irá montado bajo tierra uno de los conjuntos más delicados del futuro High-Luminosity LHC (HiLumi LHC).… Continúa leyendo »

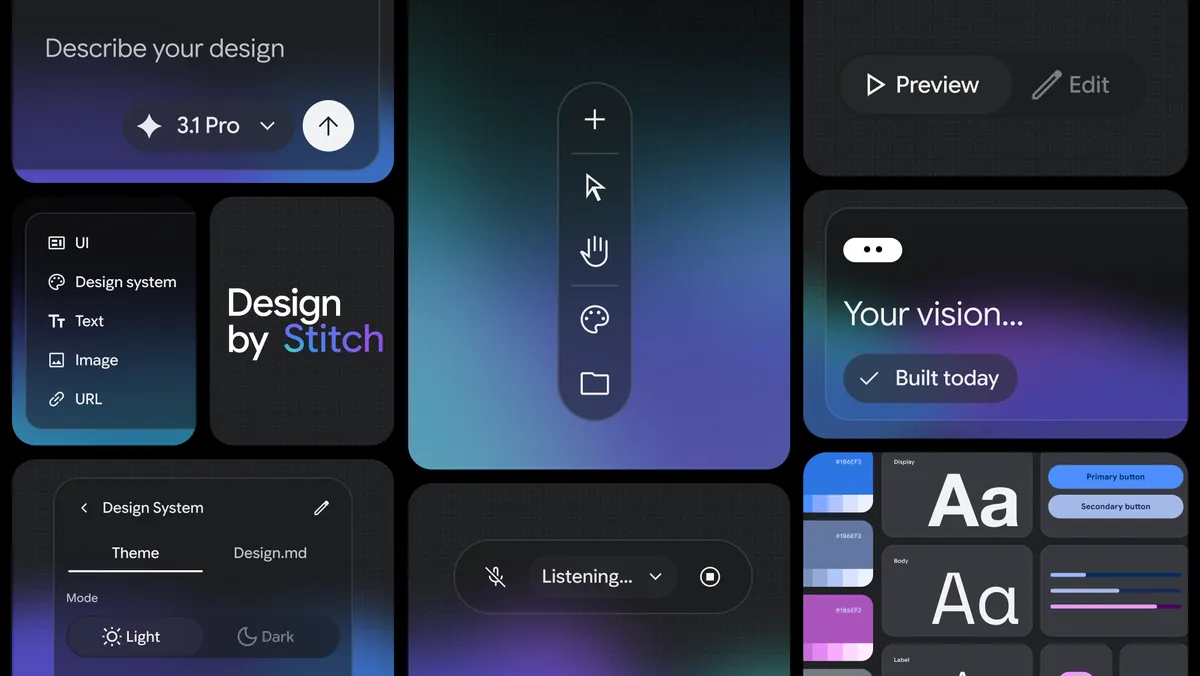

Las funciones de Gemini en Google Workspace que realmente merece la pena usar (y las que puedes ignorar)

Google lleva meses inyectando Gemini en cada rincón de Workspace: Docs, Gmail, Sheets, Slides, Meet, Drive, Calendar, Chat, Vids y Forms. Con tantas actualizaciones simultáneas, la pregunta relevante no es qué puede hacer Gemini, sino qué merece realmente tu atención en el trabajo diario. Tras revisar las funciones que Google ha desplegado recientemente, aquí va un mapa honesto de lo que funciona, lo que promete y lo que puedes ignorar sin remordimientos. Continúa leyendo «Las funciones de Gemini en Google Workspace que realmente merece la pena usar (y las que puedes ignorar)»