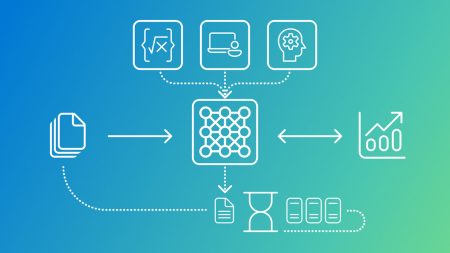

Anthropic lleva el Code Review “multiagente” a Claude Code: así funciona su nueva revisión automática de pull requests

Anthropic ha presentado Code Review, una nueva función dentro de Claude Code pensada para revisar pull requests antes de que el código llegue a producción. Según explicó la compañía en un comunicado, la herramienta se ofrece como “research preview” en beta para clientes Team y Enterprise, y busca aliviar un problema que muchas organizaciones ya… <a href="https://wwwhatsnew.com/2026/03/11/anthropic-lleva-el-code-review-multiagente-a-claude-code-asi-funciona-su-nueva-revision-automatica-de-pull-requests/">Continúa leyendo »</a>