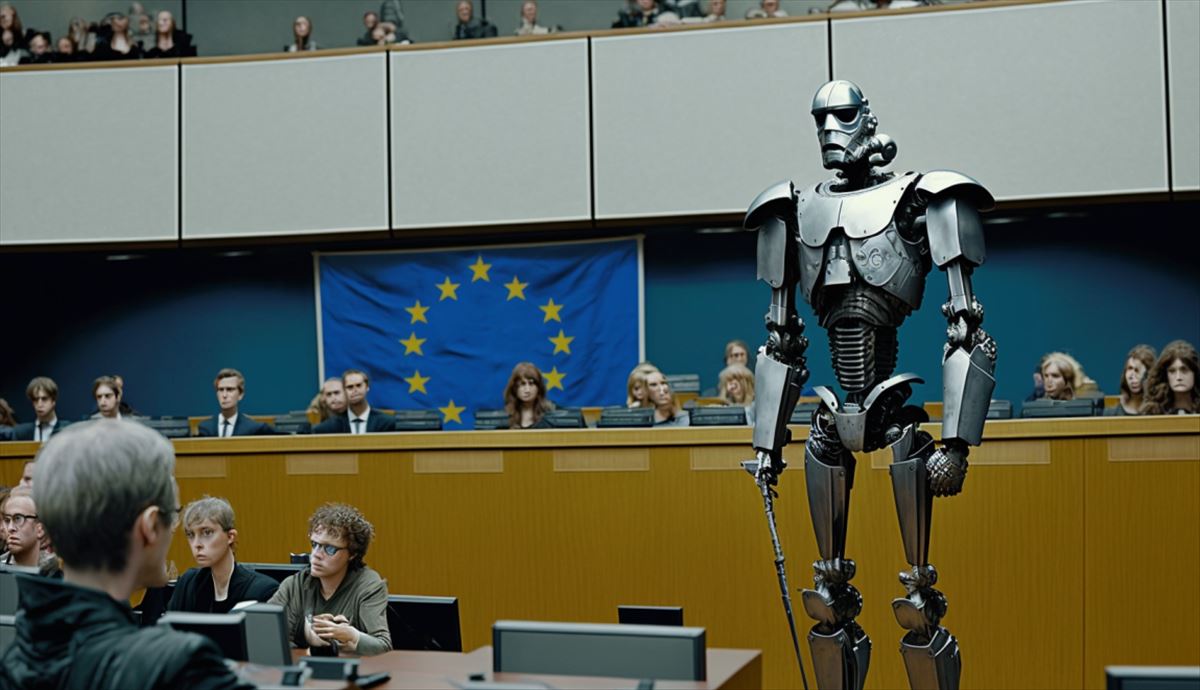

El día de hoy, el Parlamento Europeo ha dado un paso crucial al avanzar con la AI Act (Ley de Inteligencia Artificial). Este movimiento coloca a Europa a la vanguardia de la regulación global en cuanto al uso de la Inteligencia Artificial (IA), una tecnología que está transformando todos los sectores de nuestra sociedad.

Impacto sobre el uso de la IA

Bajo la nueva legislación, se establecen restricciones nunca antes vistas sobre cómo las empresas pueden hacer uso de la IA. Específicamente, la ley prohíbe la implementación de sistemas que posean un «nivel de riesgo inaceptable». Esto abarca, por ejemplo, herramientas de vigilancia predictiva o sistemas de puntuación social que clasifican a las personas según su comportamiento y estatus socioeconómico.

Limitaciones a las IA de «alto riesgo»

Además, la nueva normativa impone límites a las llamadas IA de «alto riesgo». Estas incluyen sistemas que podrían influir en las elecciones mediante manipulación de votantes, o aquellos que podrían causar perjuicios a la salud de las personas.

La lista completa sería:

1) Sistemas de IA que se utilizan en productos sujetos a la legislación de seguridad de productos de la UE. Esto incluye juguetes, aviación, automóviles, dispositivos médicos y ascensores.

2) Sistemas de IA que se clasifiquen en ocho áreas específicas que deberán registrarse en una base de datos de la UE:

- Identificación biométrica y categorización de personas físicas

- Gestión y operación de infraestructuras críticas

- Educación y formación profesional

- Empleo, gestión de trabajadores y acceso al autoempleo

- Acceso y disfrute de los servicios privados esenciales y de los servicios y prestaciones públicos

- Cumplimiento de la ley

- Gestión de migraciones, asilo y control de fronteras

- Asistencia en la interpretación jurídica y aplicación de la ley

Todos los sistemas de IA de alto riesgo se evaluarán antes de su puesta en el mercado y también a lo largo de su ciclo de vida.

Nuevas reglas para sistemas generativos de IA

La legislación también implica un cambio importante para los sistemas generativos de IA, como el famoso ChatGPT de OpenAI. A partir de ahora, se requerirá que cualquier contenido producido por estos sistemas esté debidamente etiquetado para que los usuarios puedan identificar su origen.

En un giro aún más disruptivo, el AI Act prohíbe que los modelos de IA publiquen resúmenes de datos con derechos de autor. Esto tiene el potencial de trastocar sistemas que generan un lenguaje humanoide al extraer texto de internet, a menudo de fuentes que incluyen un símbolo de copyright. Tal es el impacto que OpenAI, la empresa creadora de ChatGPT, ha manifestado que podría verse obligada a abandonar sus operaciones en Europa.

Papel de la UE en la regulación de la IA

Comparativamente, Europa lidera la regulación de la IA. Mientras que en los Estados Unidos los debates legislativos sobre la IA apenas están en su inicio, la UE ha establecido ya un marco legal sólido que se anticipa a los desafíos emergentes.

La nueva ley no surge de la nada. Se apoya en legislaciones previas sobre protección de datos, competencia en el sector tecnológico y responsabilidades de las redes sociales. Estas ya han causado cambios significativos en el funcionamiento de las empresas en Europa.

Con la aprobación del AI Act, Europa se consolida como el regulador tecnológico global por defecto. Sus políticas pueden llegar a influir en las normas tecnológicas a nivel mundial, dado que las empresas suelen adaptarse para evitar la fragmentación de políticas, aunque muchos temen que las políticas las estén haciendo personas que no saben mucho de tecnología, ni del funcionamiento de la Inteligencia Artificial.