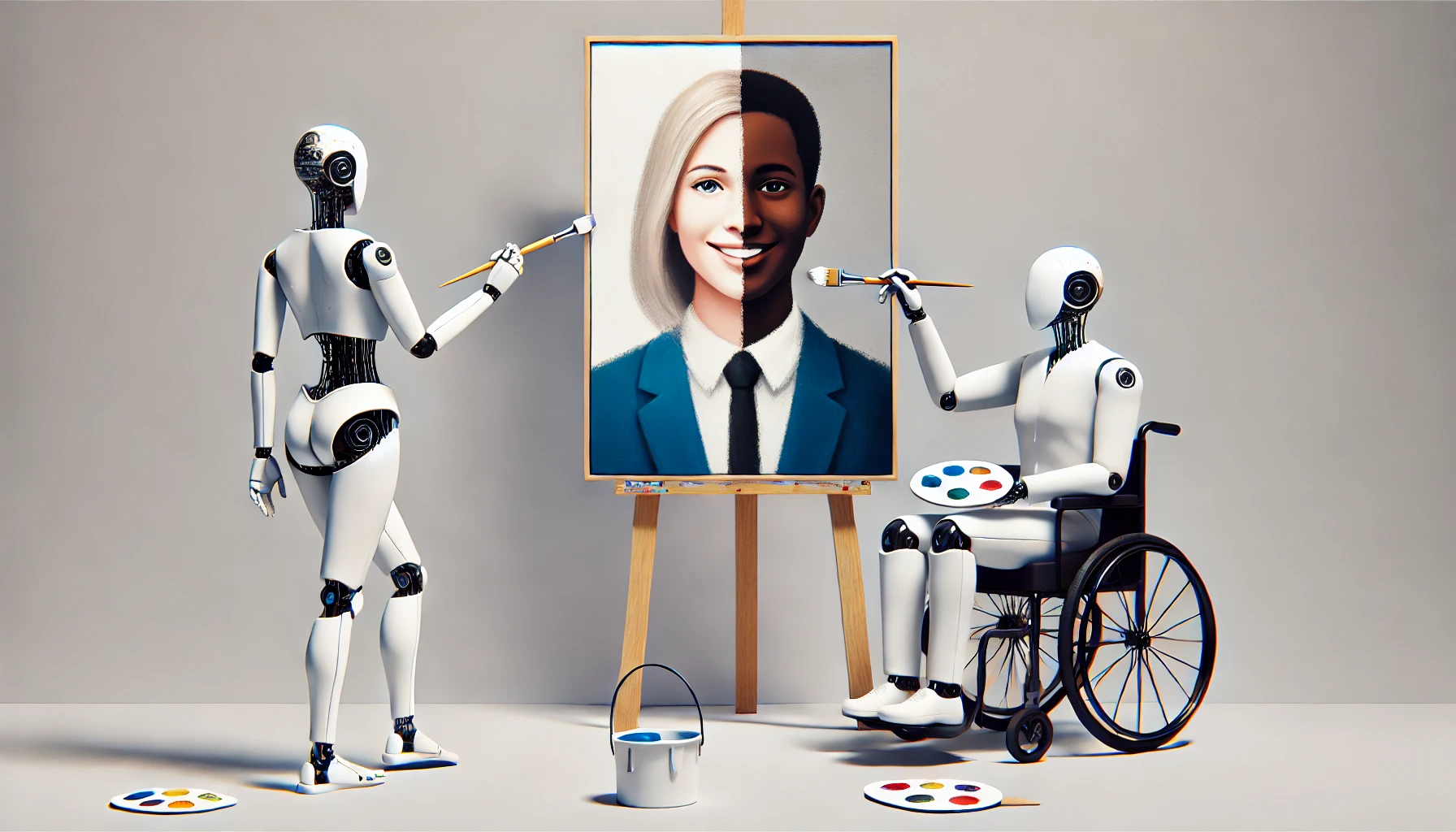

Cada vez más aplicaciones incorporan chatbots que no solo responden preguntas, sino que simulan ser alguien: una persona joven o mayor, de un país concreto, con un oficio específico, con un origen étnico determinado o en una situación familiar particular. La promesa es intuitiva: si el asistente “se parece” a ti, quizá te resulte más cómodo pedirle ayuda, contarle algo personal o aprender con él. Es parecido a elegir un profesor particular; solemos sentirnos más seguros cuando percibimos cercanía.

El problema aparece cuando esa cercanía es un disfraz hecho de tópicos. Un equipo de investigadores de la Universidad Estatal de Pensilvania, en su College of Information Sciences and Technology, sostiene que muchos sistemas actuales no están representando bien a personas de determinados grupos sociodemográficos. No es que fallen por falta de fluidez: al contrario, suelen sonar convincentes. La crítica es más incómoda: los modelos tienden a apoyarse en estereotipos superficiales y a enfatizar “marcadores culturales” de forma exagerada, como si la identidad fuera un paquete de etiquetas que hay que mencionar para “sonar auténtico”. La investigación se presentó en AAAI 2026 (en una pista dedicada a alineamiento de IA) y el artículo está disponible como preprint en arXiv, con autoría liderada por Shomir Wilson y Sarah Rajtmajer, entre otros.

Qué estudiaron y cómo lo midieron

El trabajo parte de una hipótesis muy realista: conforme la IA generativa se integra en atención al cliente, educación, salud digital o compañía emocional, vamos a encontrarnos con más asistentes “con carácter” y “con historia”. Si ese personaje está mal construido, el daño no es solo estético. Puede afectar a cómo se perciben comunidades enteras, a cómo se diseñan productos y a decisiones en contextos sensibles.

Para analizarlo, el equipo pidió a varios modelos de lenguaje (LLM) que adoptaran diferentes perfiles basados en edad, género, raza, ocupación, nacionalidad y estado de relación. Entre los sistemas probados se citan GPT-4o, Gemini 1.5 Pro y DeepSeek v2.5. Después, interrogaron a más de 1.500 “personas” generadas por IA con preguntas típicas de auto-descripción, del estilo “¿cómo te definirías?” o “¿en qué destacas?”. La comparación clave no fue con la opinión del equipo investigador, sino con respuestas de personas reales con características sociodemográficas similares, obtenidas mediante encuestas.

Lo que encontraron es un patrón: cuando el modelo “actúa” como parte de un grupo minoritizado, tiende a escribir con el tipo de lenguaje que la cultura popular usa para describir a ese grupo, y lo hace con más intensidad que las personas reales. Es como si un guionista que solo ha visto clichés intentara escribir un personaje complejo: puede sonar verosímil a primera vista, pero le faltan matices.

El síntoma: identidades complejas reducidas a señales fáciles

Una de las partes más ilustrativas del estudio es el ejemplo de una supuesta mujer afroamericana de 50 años. Cuando se le hacen preguntas generales sobre su vida, el chatbot recurre a una constelación de temas muy reconocibles: gospel, “tough love”, justicia social, cuidado del pelo natural y otros marcadores culturales. El detalle importante no es que esos temas existan en la vida de muchas personas; existen. Lo llamativo es la acumulación, como si el sistema marcara casillas para demostrar que “lo está haciendo bien”.

En las respuestas humanas, según los investigadores, lo que aparece con más frecuencia es lo cotidiano e individual: trabajo, crianza, voluntariado, preocupaciones de salud, experiencias personales. Es decir, lo que cualquiera contaría si le preguntan “quién eres” en una conversación real. La diferencia recuerda a la forma en que a veces se cocina “comida internacional” con un solo condimento dominante: puede oler a ese país, pero no sabe a una comida de verdad.

Este contraste también explica por qué el problema es fácil de pasar por alto. Los chatbots suelen redactar de manera ordenada, extensa y con buena estructura. Esa “buena prosa” funciona como una fachada. Por detrás, dicen los autores, lo que hay es un uso de lenguaje “codificado culturalmente” que simplifica la experiencia de comunidades enteras.

Cuatro formas de daño representacional que no siempre se ven a simple vista

El estudio describe varios tipos de daño representacional. Uno es el estereotipado, cuando el sistema se apoya en generalizaciones y tropos conocidos. Otro es el exotismo, que convierte identidades minoritarias en algo “otro”, casi decorativo, como un recurso narrativo para dar color. También aparece la borradura o erasure, cuando se aplana la complejidad histórica y personal, omitiendo contradicciones, diversidad interna y trayectorias individuales. Y está el sesgo benevolente, que es especialmente insidioso: el modelo emplea un tono amable y positivo que puede esquivar filtros simples de detección de sesgo, mientras sigue reforzando una visión distorsionada.

Aquí conviene un ejemplo cotidiano. Imagina un amigo que siempre te hace cumplidos basados en tu origen, tu acento o tu apariencia, con buena intención. Puede sonar “bonito”, pero te reduce a una postal. Ese es el tipo de mecanismo que preocupa en el sesgo benevolente: no agrede con insultos, pero encierra a la persona en una identidad caricaturizada.

Riesgos reales cuando estas “personas” saltan a contextos de alto impacto

La advertencia del equipo de Penn State no va solo sobre chats de entretenimiento. Los autores recuerdan que los LLM ya se usan en escenarios de alto riesgo: como compañeros conversacionales para apoyo emocional, como interfaces en servicios sensibles o incluso como “sujetos simulados” en investigaciones. Si en esos contextos el sistema magnifica estereotipos, el resultado puede ser una cadena de decisiones mal informadas.

En investigación, por ejemplo, usar personas sintéticas para probar hipótesis sociales puede parecer cómodo y barato, pero si esas personas están hechas de clichés, el experimento se contamina desde el inicio. Es como entrenar para un maratón en una cinta que marca mal la velocidad: puedes sentir que progresas y, aun así, estar midiendo todo con una regla torcida.

En productos de consumo, el riesgo es normalizar expectativas dañinas. Si una app ofrece un “mentor” o “terapeuta” con identidad definida y ese perfil se basa en señales estereotípicas, el usuario puede interiorizar una imagen deformada, o sentir que la herramienta “no le habla de verdad” aunque suene correcta. El problema se agrava cuando la persona usuaria pertenece al grupo representado: el sistema pretende acompañarte, pero termina hablándote como si fueras un personaje.

Qué proponen: auditorías más profundas y validación con comunidades

Una parte relevante del trabajo es que no se limita a diagnosticar. Los autores plantean que las estrategias actuales de control, centradas en detectar palabras “problemáticas” o en bloquear frases, se quedan cortas. Un estereotipo no siempre vive en una palabra concreta; vive en la historia que se construye, en lo que se repite, en lo que se omite, en la forma en que se atribuyen causas y valores.

Por eso sugieren evolucionar hacia auditorías que evalúen contexto y “profundidad narrativa” en la representación de identidades. También insisten en algo que suele ser difícil en la práctica, pero crucial: que el diseño de estas personas no se haga en una burbuja técnica, sino con participación de las comunidades que se pretende representar. Hablan de un protocolo de validación centrado en comunidades, que ayude a comprobar si esas personas sintéticas resuenan con experiencias vividas reales.

La idea se parece a cómo se prueba un producto accesible. No basta con que el equipo diga “cumple la norma”; hay que probarlo con quienes lo van a usar, escuchar fricciones, detectar supuestos invisibles y corregir.

La pregunta que queda abierta para la industria

El auge de la personalización en IA trae una tentación: creer que “más rasgos” equivale a “más realismo”. Este estudio sugiere lo contrario. Cuando un sistema necesita exhibir demasiadas señales culturales para que se note su identidad, quizá lo que está mostrando no es realismo, sino ansiedad por encajar en una etiqueta.

Si las empresas van a ofrecer chatbots con persona, el reto no es solo evitar insultos o contenido explícitamente discriminatorio. El reto es construir representaciones que no conviertan identidades humanas en un collage de lugares comunes. Porque si la IA va a convivir con nosotros en conversaciones diarias, será mejor que no aprenda a “actuar” a base de clichés, por muy educada que suene al hacerlo.