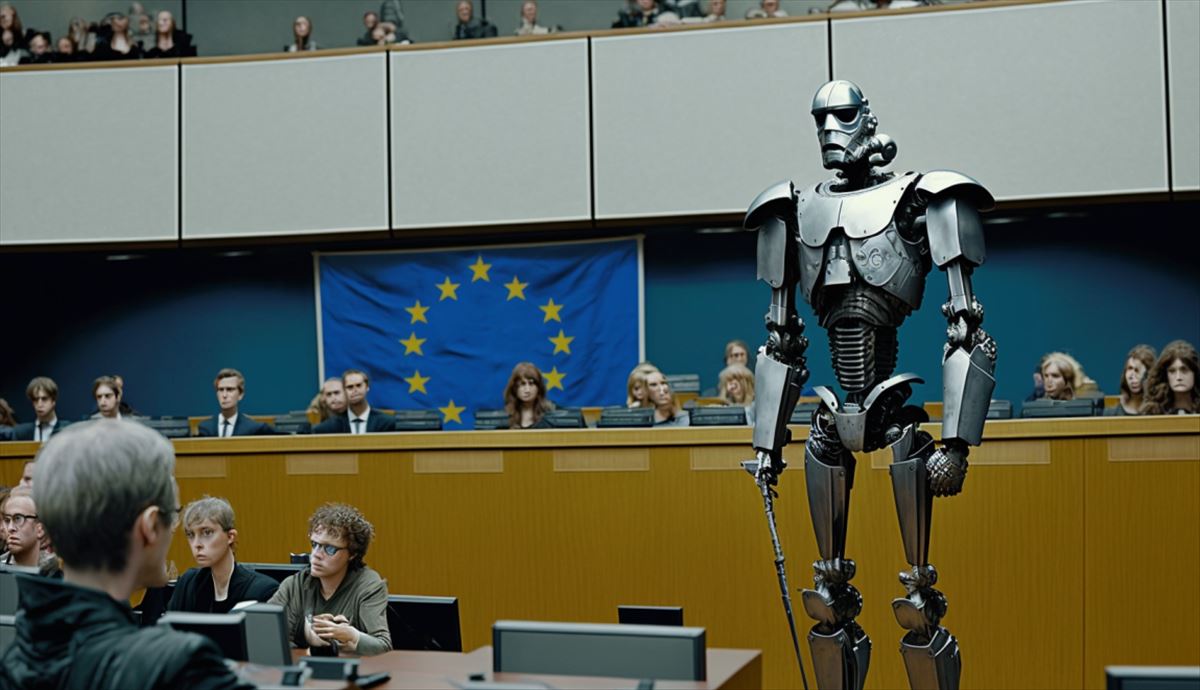

¿Alguna vez se han preguntado cómo se están estableciendo las normas para el uso de la inteligencia artificial en Europa? Veamos los detalles.

La inteligencia artificial, o IA, es una tecnología que ha captado la atención tanto del público en general como de las empresas en los últimos meses. Sus aplicaciones, como ChatGPT y Midjourney, han despertado curiosidad y fascinación. Desde escribir ensayos y poemas en cuestión de segundos hasta generar imágenes sorprendentes, la IA ha demostrado su potencial para el avance en diversos campos.

Sin embargo, esta tecnología también presenta desafíos y riesgos. Por un lado, la IA puede salvar vidas al mejorar las evaluaciones médicas, por ejemplo. Pero, por otro lado, existe el peligro de que sea utilizada de manera inapropiada o malintencionada, como en regímenes autoritarios que buscan perfeccionar la vigilancia masiva o propagar información falsa. Es por eso que la Unión Europea ha decidido tomar cartas en el asunto y establecer regulaciones que permitan aprovechar los beneficios de la IA, al tiempo que protegen los derechos fundamentales y la seguridad de las personas.

Estableciendo restricciones para un equilibrio adecuado

La Unión Europea ha puesto en marcha un proceso para crear una ley que prevenga los abusos en el uso de la inteligencia artificial. El objetivo es encontrar un equilibrio entre la innovación y la protección de las personas. Desde hace dos años, se han venido discutiendo propuestas y negociando posiciones entre los Estados miembros de la UE y la Comisión Europea.

La idea central de la propuesta de la Comisión es tener una lista de actividades consideradas «de alto riesgo» para la IA. Esto abarcaría sistemas utilizados en áreas sensibles como infraestructuras críticas, educación, recursos humanos, orden público y gestión migratoria. Para estos casos, se requeriría un control humano sobre la IA, documentación técnica y un sistema de gestión de riesgos. Cada Estado miembro de la UE contaría con una autoridad supervisora para garantizar el cumplimiento de estas normas.

Sin embargo, los miembros del Parlamento Europeo tienen diferentes opiniones sobre los criterios para definir qué aplicaciones de IA deben considerarse «de alto riesgo». Algunos proponen una definición más restringida, limitada a aquellas aplicaciones que representen una amenaza para la seguridad, la salud o los derechos fundamentales. Otros, como el grupo de Los Verdes, se oponen a esta limitación y buscan un enfoque más amplio.

Regulación de ChatGPT

En el caso de la inteligencia artificial generativa, como ChatGPT, se están considerando obligaciones específicas similares a las aplicadas en la categoría de «alto riesgo». Los legisladores también buscan que las empresas de IA implementen protecciones contra contenido ilegal y obras protegidas por derechos de autor que puedan ser utilizadas para entrenar sus algoritmos. La propuesta de la Comisión ya establece la obligación de notificar a los usuarios cuando están interactuando con una máquina de IA, así como la indicación de que la generación de imágenes ha sido creada artificialmente.

Es importante destacar que las prohibiciones absolutas de aplicaciones de IA serían raras y solo se aplicarían a aquellas que vayan en contra de los valores fundamentales de Europa, como los sistemas de vigilancia masiva y de calificación ciudadana. Los legisladores también buscan añadir prohibiciones para que la IA no pueda reconocer emociones y para eliminar excepciones que permitan la identificación biométrica remota de personas en lugares públicos por parte de las fuerzas del orden. También se pretende evitar el uso de fotos extraídas de internet para entrenar algoritmos sin obtener la autorización de las personas involucradas.

Resumen de la noticia de hoy en el Parlamento

La aprobación de nuevas reglas de transparencia y gestión de riesgos para los sistemas de IA por parte de los miembros del Parlamento Europeo (MEP) marca un paso importante para garantizar un desarrollo ético y centrado en el ser humano de la inteligencia artificial en Europa. El proyecto de mandato de negociación recibió un fuerte apoyo de la Comisión de Mercado Interior y la Comisión de Libertades Civiles, con 84 votos a favor, 7 en contra y 12 abstenciones.

Las reglas propuestas tienen como objetivo establecer pautas para la supervisión, la seguridad, la transparencia, la trazabilidad, la no discriminación y el respeto al medio ambiente de los sistemas de IA. Los eurodiputados enfatizaron la necesidad de una definición uniforme de IA que sea tecnológicamente neutral y aplicable a los sistemas de IA actuales y futuros.

Un enfoque basado en el riesgo forma la base de estas reglas, con obligaciones impuestas a los proveedores y usuarios en función del nivel de riesgo que plantea el sistema de IA. Se establecen prohibiciones estrictas para los sistemas de IA que presenten un riesgo inaceptable para la seguridad de las personas, incluidos aquellos que utilizan técnicas subliminales o de manipulación, explotan vulnerabilidades o participan en la puntuación social. Los eurodiputados ampliaron aún más la lista de prácticas prohibidas de IA para incluir usos intrusivos y discriminatorios, como sistemas de identificación biométrica remota en tiempo real, sistemas policiales predictivos y sistemas de reconocimiento de emociones en diversos contextos.

Las áreas de IA de alto riesgo se ampliaron para abarcar el daño potencial a la salud, la seguridad, los derechos fundamentales, el medio ambiente y los procesos políticos, como influir en los votantes en las campañas políticas y los sistemas de recomendación utilizados por las grandes plataformas de redes sociales. La IA de propósito general, incluidos los modelos básicos generativos como GPT, estaría sujeta a medidas de transparencia, incluida la divulgación de contenido generado por IA, la prevención de la generación de contenido ilegal y la publicación de resúmenes de datos protegidos por derechos de autor utilizados para capacitación.

Mientras promueven la innovación de la IA, las reglas también priorizan la protección de los derechos de los ciudadanos. Se introdujeron exenciones para actividades de investigación y componentes de IA proporcionados bajo licencias de código abierto. Se recomiendan entornos de pruebas reglamentarios, entornos controlados para probar la IA antes de la implementación. La legislación tiene como objetivo empoderar a los ciudadanos al permitirles presentar quejas sobre los sistemas de IA y recibir explicaciones de las decisiones que afectan sus derechos. El papel de la Oficina de IA de la UE se reformará para monitorear la implementación del reglamento de IA.

El proyecto de mandato de negociación se presentará ahora a todo el Parlamento para su aprobación en la próxima sesión de junio. Una vez aprobada, comenzarán las negociaciones con el Consejo para finalizar la ley. La importancia de esta legislación se destaca en las declaraciones de los relatores, que enfatizan la necesidad de generar confianza en los ciudadanos, establecer la forma europea de tratar con la IA y liderar el debate político mundial sobre la IA.

Protección, innovación y ética en la inteligencia artificial

La regulación de la inteligencia artificial en la Unión Europea es un paso importante hacia la protección de los derechos y la seguridad de las personas en un mundo cada vez más digitalizado. Si bien la IA ofrece un gran potencial para el avance en diversos campos, también plantea desafíos éticos y riesgos para la sociedad. Es crucial encontrar un equilibrio adecuado que permita aprovechar los beneficios de la IA sin comprometer los valores y derechos fundamentales.

El enfoque de la UE se centra en establecer restricciones para las aplicaciones de alto riesgo y promover la responsabilidad de los fabricantes de IA. Al mismo tiempo, se busca fomentar la innovación y proteger los derechos de autor y la integridad de la información. El objetivo es crear un marco legal sólido que garantice la transparencia, la rendición de cuentas y el respeto a los valores europeos.

En última instancia, la regulación de la inteligencia artificial es un desafío continuo y en constante evolución. A medida que la tecnología avanza y surgen nuevas aplicaciones, es fundamental revisar y adaptar las normas para mantener el equilibrio entre la protección de los derechos individuales y la promoción de la innovación. La Unión Europea está tomando la delantera en este proceso y se está esforzando por convertirse en un referente global en la regulación de la IA.

Más información en europarl.europa.eu