Cuando las tareas se quedan en la cabeza, la mente funciona como una mesa llena de papeles: sabes que algo importante está ahí, pero no lo encuentras cuando lo necesitas. Un buen sistema de organización de tareas no te hace “más ocupado”; te da claridad. La clave está en escoger herramientas que encajen con tu… Continúa leyendo »

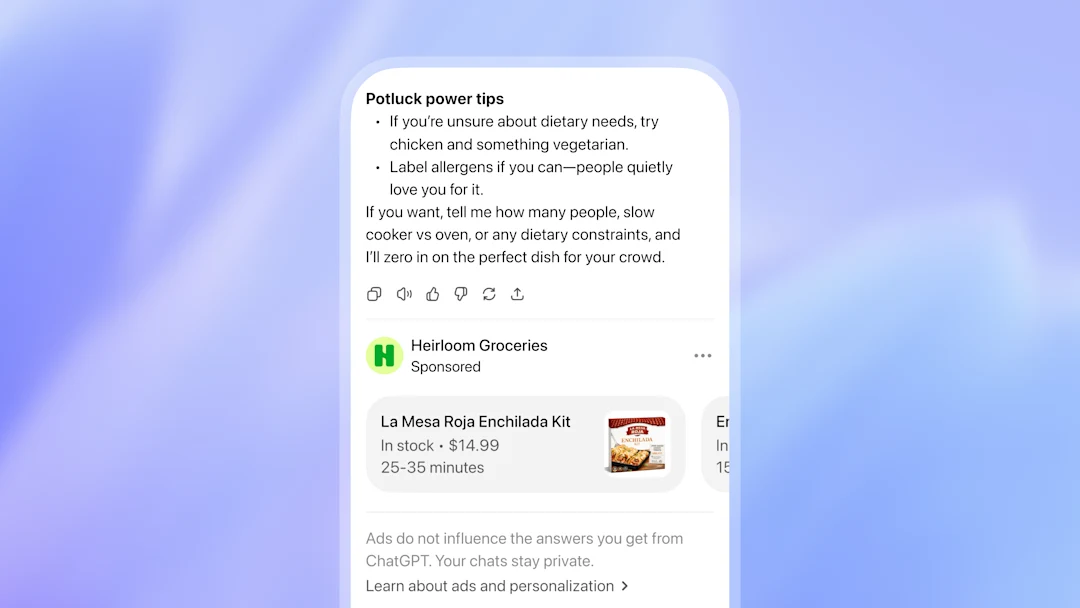

Autodesk demanda a Google por “Flow”: la batalla por una marca en plena fiebre de la IA creativa

En la industria del software, los nombres no son solo etiquetas bonitas: funcionan como el letrero de una tienda en una calle llena de escaparates. Si dos negocios colocan carteles casi iguales, el peatón entra donde no quería. Eso es, en esencia, lo que Autodesk sostiene que está ocurriendo con Google y el uso de Flow para un producto de IA orientado a la creación de vídeo.

Según informó Reuters y recogió The Verge, Autodesk ha presentado una demanda en un tribunal de California para frenar el uso del nombre Flow por parte de Google en su herramienta de generación de vídeo con inteligencia artificial. El argumento central es el riesgo de confusión entre clientes, especialmente en un momento en el que el mercado creativo está inundado de herramientas con promesas parecidas y nombres cada vez más cortos y memorables. Continúa leyendo «Autodesk demanda a Google por “Flow”: la batalla por una marca en plena fiebre de la IA creativa»