En su nota de lanzamiento del 3 de marzo de 2026, OpenAI pone el foco en tres cosas que suelen molestar cuando aparecen en exceso: el tono, la relevancia y el ritmo de la conversación. Son detalles “humanos” que a veces no se reflejan bien en pruebas de laboratorio, pero que en la práctica deciden… Continúa leyendo »

Phi-4-reasoning-vision-15B: el modelo multimodal compacto de Microsoft que “piensa” solo cuando conviene

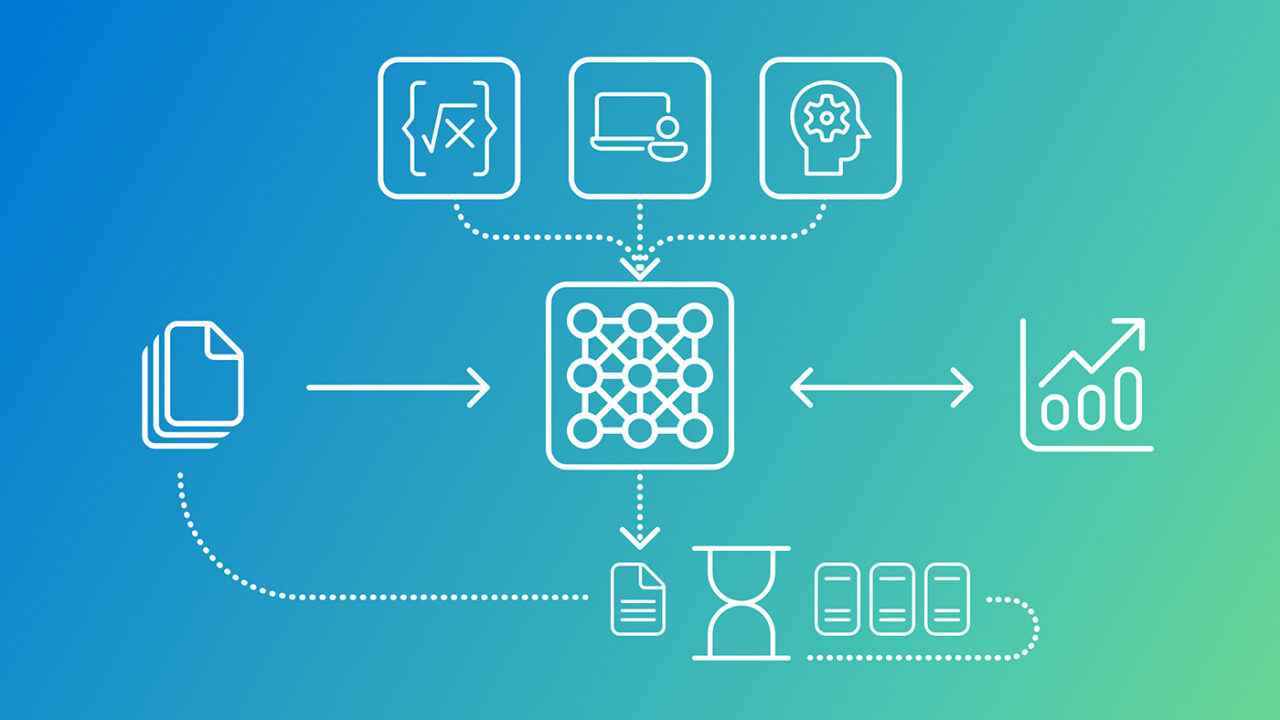

Microsoft Research ha presentado Phi-4-reasoning-vision-15B, un modelo multimodal de 15.000 millones de parámetros con pesos abiertos, pensado para combinar visión y lenguaje sin disparar costes de cómputo ni latencia. La idea es sencilla de entender con un ejemplo cotidiano: no necesitas sacar una calculadora científica para apuntar un número de teléfono, pero sí para resolver una integral. Este modelo intenta hacer justo eso: responder “directo” cuando la tarea es perceptiva (leer, describir, localizar) y activar un razonamiento más largo cuando el problema lo pide, como en matemáticas y ciencias.

Según Microsoft Research, está disponible en Microsoft Foundry, Hugging Face y GitHub, con un enfoque claro: ofrecer una opción compacta que sea competitiva en tareas clásicas de visión-lenguaje, y especialmente sólida cuando hay que razonar con información visual o entender interfaces. Continúa leyendo «Phi-4-reasoning-vision-15B: el modelo multimodal compacto de Microsoft que “piensa” solo cuando conviene»