Una investigación de Fairlinked e.V. (asociación europea de usuarios comerciales de LinkedIn) bautizada como BrowserGate ha revelado que LinkedIn inyecta un bundle de JavaScript de 2,7 MB en cada carga de página que escanea silenciosamente el navegador del usuario buscando más de 6.000 extensiones de Chrome, recopila 48 características del dispositivo (núcleos de CPU, memoria,… Continúa leyendo »

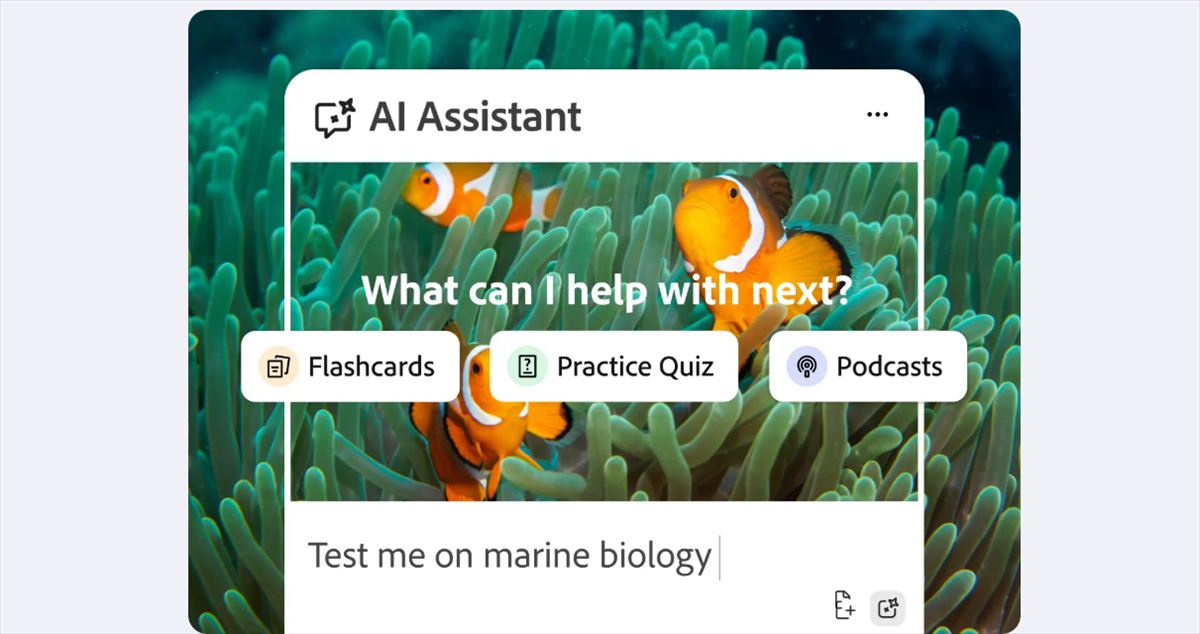

Adobe lanza Acrobat Student Spaces: una herramienta gratuita de IA para estudiantes que convierte PDFs y apuntes en flashcards, mapas mentales y podcasts

Adobe ha presentado Acrobat Student Spaces, una herramienta gratuita de estudio impulsada por IA que convierte materiales de clase (PDFs, apuntes, enlaces, transcripciones, archivos de PowerPoint o Excel, incluso notas manuscritas) en flashcards, cuestionarios, mapas mentales, podcasts, presentaciones editables y resúmenes de audio. Ya disponible en beta y sin coste, sin necesidad de iniciar sesión. Continúa leyendo «Adobe lanza Acrobat Student Spaces: una herramienta gratuita de IA para estudiantes que convierte PDFs y apuntes en flashcards, mapas mentales y podcasts»