La promesa de una movilidad más segura y eficiente a través de vehículos autónomos ha capturado la imaginación del mundo. Pero el reciente incidente en San Francisco con un robotaxi de Cruise, una subsidiaria de General Motors, ha generado preguntas críticas sobre la preparación tecnológica y ética para el despliegue masivo de esta tecnología.

El 2 de octubre de 2023, un vehículo autónomo de Cruise, apodado Panini, se vio involucrado en un incidente de atropello y fuga. Según la empresa, el vehículo estaba detenido en un semáforo en rojo cuando un Nissan Sentra golpeó a un peatón que cruzaba la calle, lanzándolo directamente en la trayectoria del vehículo autónomo de Cruise. Aunque el vehículo intentó frenar y desviarse, terminó haciendo contacto con el peatón.

El DMV de California suspendió las operaciones de Cruise en el estado, citando preocupaciones sobre la seguridad de los peatones. La NHTSA también ha iniciado una investigación sobre la seguridad de los vehículos autónomos de Cruise.

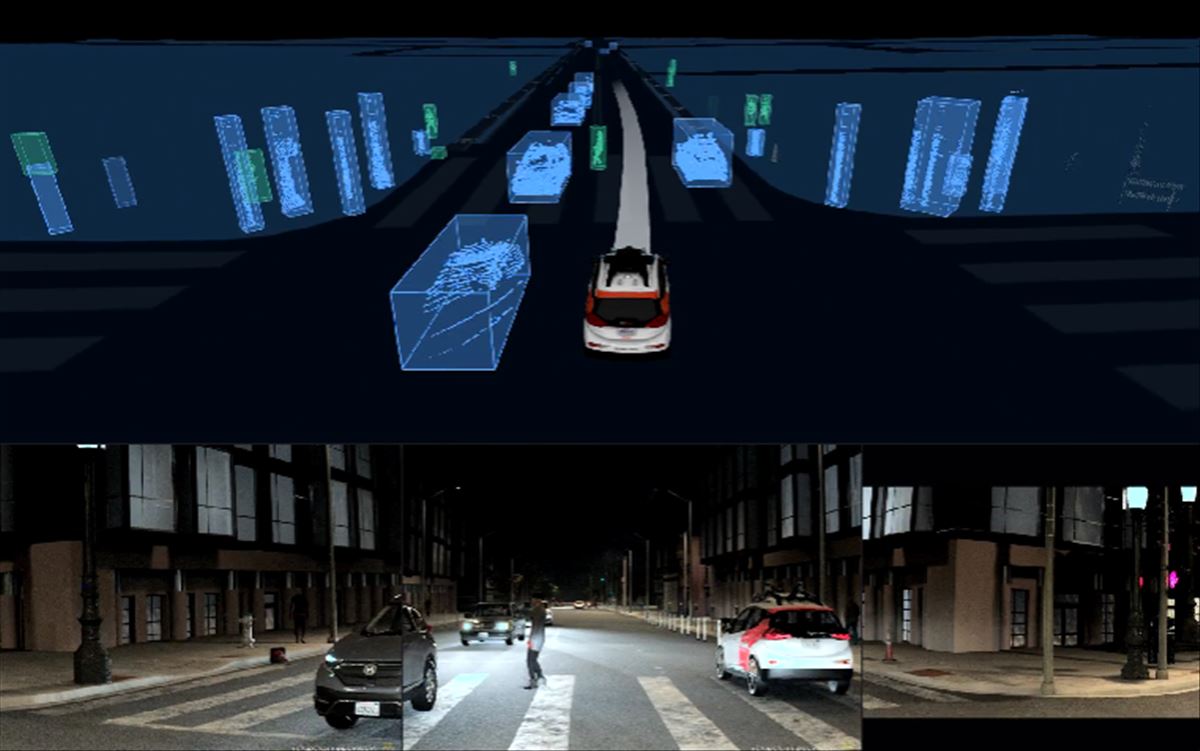

Cruise ha sido transparente sobre el incidente, compartiendo información con las autoridades y realizando análisis internos para mejorar la seguridad. Según las simulaciones de la empresa, si el vehículo autónomo hubiera estado en lugar del Nissan Sentra, habría detectado y evitado al peatón. Cruise también señaló que su vehículo respondió al incidente en 460 milisegundos, más rápido que la mayoría de los conductores humanos. En la imagen superior se puede ver una captura de la simulación que han compartido en su respuesta.

El incidente ha revelado limitaciones en los sensores y algoritmos de los vehículos autónomos de Cruise. La empresa utiliza datos en carretera y escenarios definidos por organismos reguladores y de la industria para validar el rendimiento del sistema en escenarios de colisión inminente. Sin embargo, este evento particularmente raro no estaba incluido en esos escenarios. Aún así, si en lugar de ser autónomo, hubiera habido un humano el volante, seguramente el accidente habría ocurrido igualmente.

Cruise ha acumulado más de 5 millones de km de conducción y sostiene que sus vehículos son más seguros que un conductor humano en entornos urbanos densos. Sin embargo, el incidente muestra que aún hay margen para mejorar, especialmente en la adaptación a escenarios extremadamente raros. El tema es ¿es posible reducir aún más los 460 ms de respuesta? ¿el hecho de ser autónomo significa que no puede haber un accidente nunca?

El incidente con Cruise en California subraya la complejidad y los desafíos inherentes a la implementación segura de vehículos autónomos. No solo se trata de superar las limitaciones tecnológicas, sino también de navegar por un paisaje ético y regulatorio en constante evolución. La seguridad no es un destino, sino un viaje continuo, y este caso sirve como un recordatorio crítico de esa realidad, pero tampoco podemos culpar a la tecnología ante algo así. Si un coche atropella a un peatón y lo empuja hacia otro coche, la probabilidad de que algo grave ocurra es alta, sea autónomo o no.

Una cosa que sí se podría hacer es hacer los coches más previsores, que imaginen las posibilidades de que pueda haber un accidente a su alrededor, y que si esa probabilidad es mayor de un margen específico, el coche reduzca enormemente su velocidad, aunque entonces igual dejan de ser prácticos en un entorno urbano.