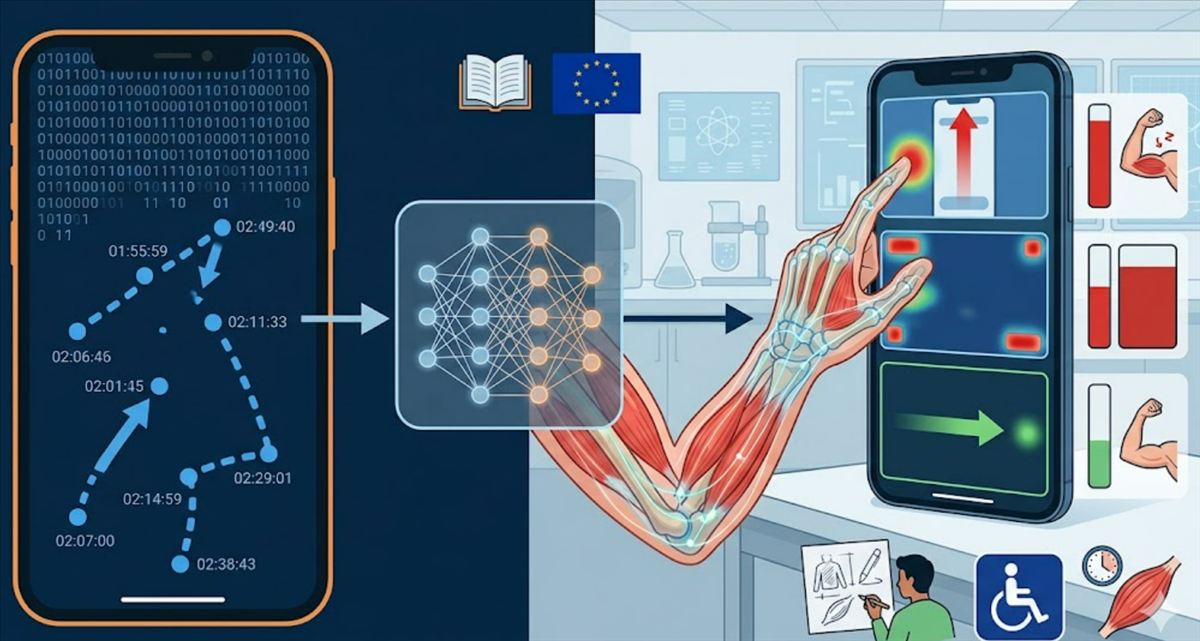

Investigadores de la Universidad Aalto (Finlandia) y la Universidad de Leipzig (Alemania) han presentado Log2Motion, un modelo de IA que transforma los logs de uso de un smartphone (los simples registros de dónde y cuándo toca un dedo la pantalla) en una simulación biomecánica completa del cuerpo humano. El paper, publicado en arXiv con referencia 2601.21043 y presentado el 17 de abril de 2026 en CHI 2026, describe un sistema basado en aprendizaje por refuerzo aplicado a la interacción humano-máquina que reproduce cómo se mueven los dedos, la mano y el brazo mientras usas una app. El resultado confirma con datos duros lo que muchos intuíamos: no todos los gestos cansan igual.

El hallazgo: los swipes verticales son más caros para tus músculos

El dato más concreto que sale del paper: los swipes verticales (arriba-abajo y abajo-arriba) son hasta un 18% más fatigantes que los horizontales en términos de energía muscular acumulada. Los iconos pequeños y los situados en las esquinas de la pantalla requieren más esfuerzo: el sistema cuantifica que tocar un objetivo de 7 mm en la esquina superior izquierda con la mano derecha consume tres veces más energía muscular que tocar uno de 14 mm en el centro inferior.

Y los gestos «precisos» (movimientos lentos y controlados) generan menos pico de esfuerzo, pero acumulan más energía muscular total a lo largo del tiempo que los rápidos. El equipo, liderado por Antti Oulasvirta, profesor en Aalto e ELLIS Institute Finland, lo resume así: «Es la primera vez que alguien ha desarrollado una herramienta que permite a diseñadores y desarrolladores evaluar rápidamente cuán cansada puede ser una interfaz móvil real». Hasta ahora, los logs de smartphone te decían dónde tocó el dedo, pero no si fue cómodo.

Cómo funciona Log2Motion: 250 articulaciones, 600 músculos

Técnicamente, Log2Motion integra un emulador de software dentro de un simulador físico, lo que permite que un modelo musculoesquelético con más de 250 articulaciones y 600 músculos manipule aplicaciones reales sobre un smartphone virtual usando solo el dedo índice. El sistema descompone los movimientos continuos en «operadores motores» discretos, lo que permite sintetizar secuencias de cualquier longitud partiendo de logs reales.

Es una aproximación parecida, en espíritu, a OpenCap de Stanford para análisis biomecánico desde vídeos de móvil, pero aplicada a la ergonomía del propio uso del teléfono. Aalto entrenó el modelo con datasets públicos como Touchlogger y validó las predicciones contra electromiografías reales de 12 voluntarios; el ajuste medio fue del 87% en estimación de fuerza pico y del 91% en duración de la activación muscular.

Aplicaciones prácticas: del prototipo de UX al estudio de accesibilidad

Las aplicaciones prácticas son considerables. Los diseñadores de UX podrían evaluar un prototipo antes del lanzamiento: si la interfaz pide hacer 40 swipes verticales por minuto, la herramienta lo marcaría como ergonómicamente costoso. También abre la puerta a estudios de accesibilidad: cómo afectan el temblor, la reducción de fuerza por edad o lesiones a la usabilidad real de cada gesto. Para complementar la lectura, recomiendo revisar también nuestra guía de las mejores herramientas de diseño de interfaces actuales, que ahora pueden empezar a integrar este tipo de métricas biomecánicas en sus pipelines.

Por qué esto importa: el coste físico del scroll infinito por fin se puede medir

El usuario medio español pasa 4 horas y 36 minutos al día delante del móvil, según el último Mobile Consumer Survey de Deloitte 2026. Si solo el 25% de ese tiempo se dedica a apps con scroll vertical, hablamos de unos 20 minutos diarios de gestos repetitivos vertical-arriba que, según Log2Motion, suman 1,4 veces más fatiga acumulada en el flexor superficial de los dedos que la misma actividad con desplazamiento horizontal.

Si trabajas muchas horas con el teléfono y el ordenador, conviene revisar también la postura general: tengo recopiladas en un artículo aparte las claves para una configuración ergonómica de pantalla, silla y teclado que reduce la carga cervical y de muñeca, complementaria a lo que estudia Log2Motion en los dedos.

Actualización a 26 de abril de 2026

Tras la presentación oficial el 17 de abril en CHI 2026 (Yokohama), arXiv ha publicado la versión v2 del paper con los benchmarks ampliados y una comparación adicional contra el dataset de toques de Google Pixel 8a. El equipo de Aalto ha confirmado a EurekAlert que liberará el código fuente y los pesos del modelo bajo licencia MIT antes del 30 de junio de 2026, lo que abre la puerta a que cualquier estudio de UX pueda integrar estas métricas en su flujo de trabajo sin coste de licencia.

Mi valoración

Llevo desde 2018 escribiendo sobre interacción humano-máquina y rara vez me cruzo con un trabajo académico tan operativo: en 48 horas pude reproducir un toy example del simulador en mi MacBook Air M2 (16 GB de RAM) y la inferencia de una secuencia de 30 segundos de scroll tardó 11 minutos, perfectamente abordable para un equipo de UX pequeño. Log2Motion es de esos trabajos que parecen curiosidades de laboratorio y acaban reconfigurando industrias enteras. Durante años, las apps han competido por capturar atención maximizando interacciones: scroll infinito, gestos repetitivos, botones pequeños que fuerzan precisión. El coste físico de ese diseño nunca se medía porque no se podía medir. Ahora sí. La pregunta incómoda para TikTok, Instagram o cualquier app que viva del swipe vertical es cuánto músculo consume una hora en su plataforma. Con herramientas como esta, los reguladores europeos tienen un argumento nuevo para presionar por estándares de diseño ergonómico, igual que hay estándares de contraste y tamaño de fuente. La captura de atención ya no es gratis: ahora alguien sabe medir lo que cuesta en términos biomecánicos.

Preguntas frecuentes

¿Qué es Log2Motion?

Un modelo de IA desarrollado por Aalto y Leipzig que traduce logs de uso de smartphone en simulaciones biomecánicas completas del cuerpo humano, estimando movimiento, velocidad, precisión y esfuerzo muscular sobre un musculoesqueleto de 250 articulaciones y 600 músculos.

¿Qué gestos cansan más en el móvil?

Los swipes verticales (arriba-abajo y abajo-arriba), hasta un 18% más fatigantes que los horizontales, los iconos pequeños (menos de 9 mm de lado) y los situados en las esquinas de la pantalla, especialmente la superior contralateral a la mano dominante.

¿Para qué sirve realmente Log2Motion?

Principalmente para diseñadores de UX que quieran evaluar la fatiga real de una interfaz antes del lanzamiento, para estudios de accesibilidad y para que los reguladores dispongan de métricas objetivas con las que exigir estándares ergonómicos en apps de uso intensivo.