Adobe ha presentado Firefly AI Assistant, una nueva capa conversacional dentro de Adobe Firefly pensada para que el creador describa lo que busca y el sistema se encargue de coordinar los pasos necesarios entre aplicaciones de Creative Cloud. La idea es simple de explicar y ambiciosa de ejecutar: en lugar de saltar de Photoshop a Premiere, de ahí a Lightroom y luego a Express para rematar, el usuario plantea el objetivo en lenguaje natural y el asistente orquesta el flujo de trabajo de varios pasos desde un único lugar. Según Adobe, esta experiencia llegará “próximamente” en forma de beta pública dentro de Firefly.

Lo interesante es el cambio de interfaz mental. En la práctica, el mensaje de Adobe es que el trabajo creativo debería parecerse menos a “operar una cabina de mandos” y más a conversar con un productor que entiende el encargo, te hace preguntas para afinarlo y mueve los engranajes por detrás. Medios como Reuters han subrayado la intención de Adobe de integrar este enfoque con modelos externos como Claude de Anthropic, lo que apunta a un ecosistema menos encerrado en una sola herramienta.

“Creatividad agéntica”: tú pones el gusto, la IA pone la logística

Adobe está enmarcando el lanzamiento en un concepto que se repite en su comunicación: creatividad agéntica. Traducido a un ejemplo cotidiano, es como cocinar con un pinche de cocina muy rápido: tú decides el plato, el punto de sal y el emplatado; el asistente pela, corta, precalienta el horno y mantiene la encimera ordenada. La promesa no es sustituir criterio o estilo, sino reducir fricción y tiempo en tareas mecánicas.

En la presentación, David Wadhwani (responsable del negocio de creatividad y productividad de Adobe) enfatiza que el creador conserva el control y que su perspectiva y gusto actúan como guía. Esa insistencia en la “dirección creativa” es clave para entender el enfoque: el asistente pregunta, propone y ejecuta, pero no “decide” por ti si no se lo pides.

Un contexto que no se pierde: continuidad entre sesiones y aplicaciones

Uno de los puntos más prácticos es la continuidad. Adobe plantea que el asistente mantenga el contexto, el progreso y las decisiones entre sesiones, y que ese hilo se traslade a distintas apps sin tener que reexplicar el proyecto desde cero. En el día a día, esto puede significar algo tan mundano como retomar un diseño al día siguiente y que el sistema recuerde la intención: formato, estilo, recursos de marca, versiones previas y ajustes ya aprobados.

Aquí Firefly funciona como “mesa central” del estudio: en vez de abrir cajones por separado, el asistente se mueve por el taller, trae herramientas y vuelve con resultados. La utilidad real dependerá de lo fino que sea ese entendimiento del contenido y del contexto, porque no es lo mismo “hazlo más cálido” en una foto de producto que en un retrato con tonos de piel delicados.

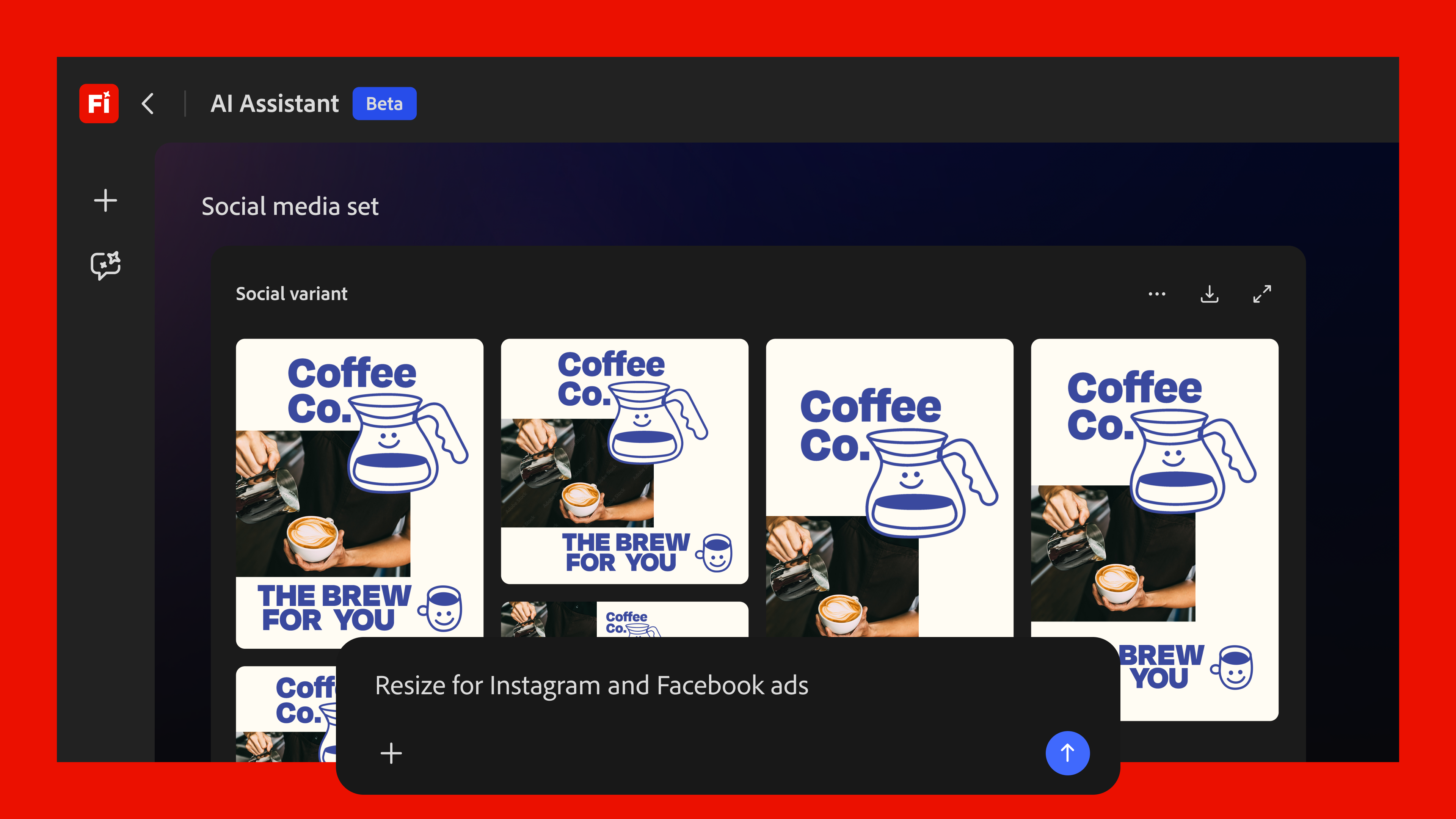

Creative Skills: de un prompt a una receta repetible

Otro componente clave son las Creative Skills, una biblioteca de acciones predefinidas (y personalizables) para ejecutar tareas de varios pasos a partir de una sola instrucción. Adobe las describe como habilidades pensadas para flujos creativos, con la posibilidad de usar opciones ya preparadas o crear las propias para mantener coherencia, por ejemplo en retoque, exportación para canales o variantes por formato.

En la práctica, esto puede convertirse en la diferencia entre “hacer algo rápido” y “hacerlo siempre igual de bien”. Si has trabajado con equipos, sabes que la consistencia es una batalla silenciosa: tipografías, márgenes, LUTs, niveles de audio, nombres de archivo, tamaños para social. Un sistema que encapsule esas decisiones como una receta reutilizable puede ahorrar discusiones y, sobre todo, errores.

Personalización: cuando el asistente aprende tus manías (en el buen sentido)

Adobe también habla de personalización con el tiempo: que el asistente aprenda preferencias de herramientas, flujos y elecciones estéticas para producir resultados más consistentes. En términos humanos, sería el compañero que ya sabe que siempre recortas a 4:5 para Instagram, que prefieres sombras suaves en producto, o que tiendes a limpiar ruido antes de tocar color.

Esto abre una oportunidad y un reto. La oportunidad es que el sistema se vuelva más útil cuanto más lo uses. El reto es evitar que “aprenda” hábitos que luego limiten la exploración creativa, o que confunda tu estilo con una plantilla rígida. Si la personalización está bien diseñada, debería ser un punto de partida, no una jaula.

Frame.io como puente entre crear y aprobar

La integración con Frame.io apunta al cuello de botella clásico: revisión y feedback. Adobe plantea que el asistente pueda organizar y compartir el trabajo para revisión, interpretar comentarios y aplicar cambios con herramientas adecuadas, acortando el ciclo de ida y vuelta hasta el material final.

Si alguna vez has recibido un “hazlo más dinámico” o “se ve raro el color” sin más contexto, sabes que la parte difícil no es mover un slider, sino traducir ese comentario a acciones concretas. La promesa aquí es que el asistente actúe como traductor entre lenguaje humano y operaciones técnicas. La pregunta interesante será cómo gestiona ambigüedades: cuándo pregunta, cuándo propone alternativas y cuándo ejecuta sin romper nada.

Firefly Video Editor: audio de estudio, color con control y una despensa gigantesca

Junto al asistente, Adobe ha ampliado capacidades de edición en Firefly Video Editor, con un enfoque en tres áreas que suelen consumir tiempo. La primera es el audio: incorpora herramientas de mejora de voz similares a las usadas en Premiere y Adobe Podcast para limpiar diálogo, reducir ruido y reverberación y equilibrar elementos como música y ambiente.

La segunda área es el color, con controles para exposición, contraste, saturación, temperatura y ajustes finos, combinando deslizadores para precisión con looks de arranque rápido. La tercera es integración con Adobe Stock, que según la compañía da acceso a un catálogo masivo de recursos licenciados directamente dentro del flujo de trabajo, evitando el típico “sal de aquí, busca, descarga, vuelve, importa”.

Precision Flow y AI Markup: editar con IA sin sentir que conduces a ciegas

En imagen, Adobe introduce dos ideas que responden a una queja común sobre la IA generativa: “me da opciones, pero me cuesta llegar justo a lo que quería”. Precision Flow propone explorar variaciones desde un solo prompt con un control deslizante que recorre desde cambios sutiles hasta transformaciones más intensas, sin reiniciar el proceso cada vez.

AI Markup, por su parte, busca que el usuario indique “dónde” y “cómo” aplicar cambios, usando herramientas como pincel, rectángulo o referencias para guiar la edición. Es un paso importante porque convierte la edición generativa en algo más parecido a enmascarar y retocar, que es un lenguaje familiar para profesionales: no estás pidiendo magia generalista, estás señalando el área y la intención.

Un catálogo de modelos más amplio: elección como estrategia

Adobe también está ampliando el catálogo de modelos de IA disponibles en Firefly, superando la treintena según su comunicación, incorporando opciones de terceros como Kling 3.0 y Kling 3.0 Omni, y manteniendo modelos propios orientados a uso comercial. En la práctica, esto se parece a tener varias lentes en una misma cámara: algunas son mejores para retrato, otras para acción, otras para vídeo con control de cámara. Lo valioso es que el creador elija según el resultado buscado, no según la herramienta a la que esté “atado”.

En paralelo, Adobe ha confirmado que llevará esta forma de crear hacia modelos externos, citando a Claude de Anthropic como ejemplo. Paul Smith, directivo de Anthropic, ha descrito el flujo “pensar en Claude y ejecutar en Firefly” como una vía para acortar distancia entre idea y producción.

Disponibilidad, planes y el papel de Adobe Summit 2026

En cuanto a disponibilidad, Adobe indica que Firefly AI Assistant llegará en beta pública en las próximas semanas dentro de Firefly, mientras que las nuevas capacidades de edición de vídeo e imagen y el acceso a nuevos modelos de partners ya están disponibles para clientes con plan de Firefly. La compañía también encuadra estas novedades en Adobe Summit 2026, donde quiere mostrar cómo la IA agéntica puede ayudar a equipos creativos y de marketing a escalar producción alineada con marca a lo largo del ciclo de vida del cliente.

Queda por ver cómo se comporta este enfoque cuando el proyecto se complica: identidades de marca estrictas, entregas con múltiples aprobadores, narrativas largas, material rodado irregular. Aun así, la dirección es clara: menos fricción entre intención y ejecución, más control para el creador y una interfaz que se parece más a conversar con un colega competente que a memorizar menús.

Mi valoración

Adobe está jugando una partida diferente al resto: en lugar de competir por el modelo más espectacular, busca convertirse en la capa de orquestación que coordina varios modelos según la tarea. Firefly AI Assistant es la pieza que une todo. Si funciona como demuestran las demos, libera al diseñador de tareas mecánicas (escalar, exportar, sincronizar versiones) y le devuelve tiempo para decisiones creativas. Si falla, Adobe pierde la narrativa frente a alternativas más ágiles como Freepik AI Suite y modelos abiertos. La pregunta no es si Adobe va a ganar la guerra de la IA, sino si va a ser capaz de mantener su posición en el centro del workflow profesional.

Qué viene después de Adobe Summit 2026

Actualización a 25 de abril de 2026: Adobe Summit (San Francisco, 17-19 marzo) confirmó la disponibilidad pública de Firefly AI Assistant en beta para suscriptores Creative Cloud All Apps, con disponibilidad general programada para junio. La integración con Premiere y Photoshop está completa; Illustrator y InDesign se incorporan en mayo. El blog oficial de Adobe mantiene un changelog actualizado de qué Skills están operativos en cada app.

El otro frente que se ha movido es el de competencia: Canva ha lanzado su propio asistente equivalente y Microsoft ha integrado capacidades similares en Designer dentro de Microsoft 365. La diferencia operativa de Adobe está en el contexto persistente entre apps, algo que ningún competidor ofrece todavía con la misma profundidad.

Preguntas frecuentes

¿Qué es Firefly AI Assistant?

Un asistente conversacional integrado en Adobe Creative Cloud que orquesta tareas entre Photoshop, Premiere, Illustrator y otras apps mediante prompts en lenguaje natural y Skills reutilizables.

¿Está disponible en español?

Sí, desde el lanzamiento en abril de 2026 incluye soporte para español, inglés, francés, alemán, japonés y portugués.

¿Cuánto cuesta?

Está incluido en cualquier plan Creative Cloud All Apps (desde 76,99 €/mes en España, 24,19 €/mes con plan individual), sin coste adicional. El consumo intensivo de modelos generativos como Kling 3.0 sigue rigiéndose por créditos generativos del plan correspondiente.