La inteligencia artificial (IA) ha transformado significativamente la manera en que interactuamos con la información en línea. Una de las herramientas más notorias en este campo es el sistema de resúmenes generados por IA de Google, conocido como «AI Overview». Esta función promete sintetizar información clave de las búsquedas para facilitar el acceso rápido a datos relevantes. Sin embargo, recientes errores, como la inclusión de un elefante en miniatura «adorable e imposible» en un resultado de búsqueda, han generado preguntas sobre su efectividad y fiabilidad.

El caso del elefante miniatura

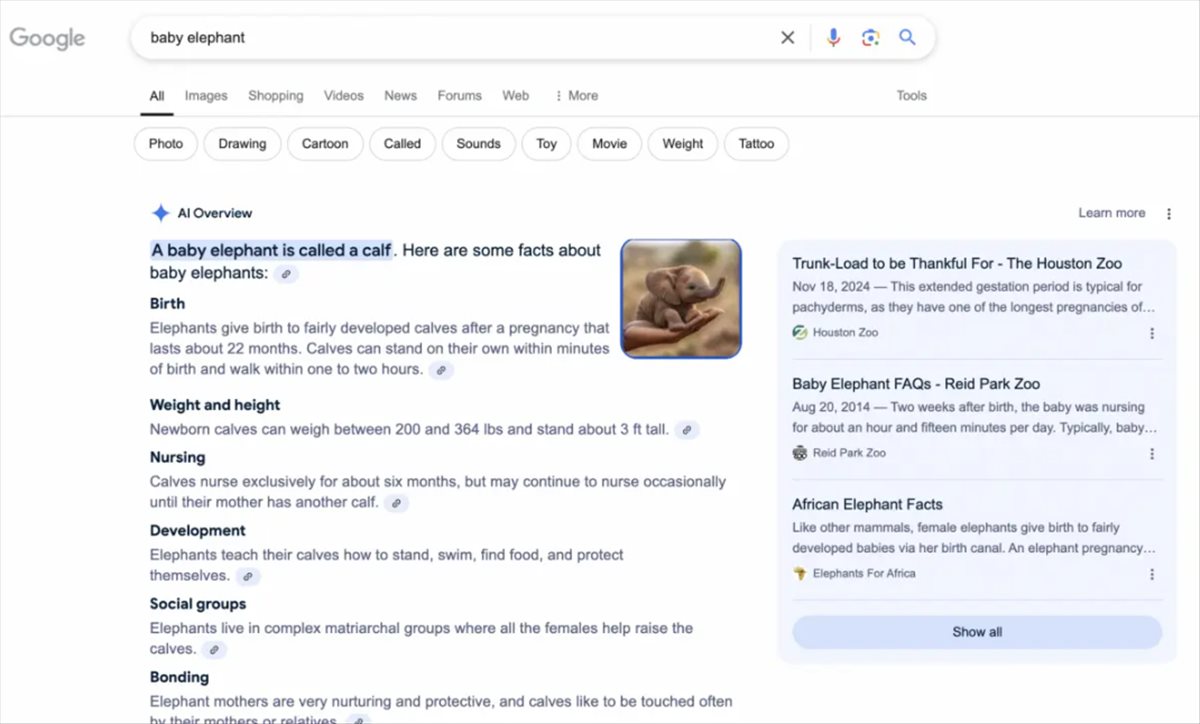

Al buscar información sobre «baby elephant» en Google, la IA ofrece un resúmen que, en términos generales, es preciso. Menciona que los elefantes recién nacidos pesan más de 200 kg y miden aproximadamente un metro de altura. Sin embargo, también incluye una imagen de un elefante del tamaño de una taza de té, acurrucado en la palma de una mano humana. Aunque esta imagen es evidentemente ficticia, el hecho de que aparezca junto a datos reales genera confusión.

La ilustración, creada por un vendedor de Etsy llamado «DazzlingVisions», es descrita como un arte digital que representa un elefante «adorable e imposible». La paradoja radica en que, a pesar de que el propio creador admite que la imagen es irreal, el sistema de Google la integró en su resumen como si fuera una representación fáctica.

Errores similares en el pasado

El caso del elefante no es un incidente aislado. Desde su lanzamiento, el sistema de AI Overview ha cometido varios errores que han sido ampliamente criticados. Por ejemplo, en 2024, se reportaron recomendaciones absurdas, como sugerir que comer piedras podría ser beneficioso para la salud. Este consejo provino de una confusión con un artículo satírico publicado por The Onion, un medio conocido por su humor irónico.

Otros ejemplos incluyen:

- La afirmación de que Barack Obama fue el «primer presidente musulmán», lo que revivía teorías conspirativas desacreditadas.

- Consejos cuestionables para entrenar niños en el baño, basados en fuentes no verificadas.

- Errores en datos geográficos que confundieron regiones enteras.

Estos incidentes revelan una carencia de matices y un análisis deficiente de las fuentes por parte del sistema. La IA no siempre distingue entre información verificable y contenido humorístico, ficcional o engañoso.

Desafíos en la selección de fuentes

El principal problema parece residir en cómo el sistema prioriza y valida las fuentes de información. En muchos casos, la IA toma contenido literalmente, sin considerar el contexto o la intención del autor. Por ejemplo, un comentario en Reddit o una pieza satírica pueden ser tratados como hechos si no hay un mecanismo para evaluar su credibilidad.

Esto plantea una pregunta clave: ¿está realmente lista la inteligencia artificial para manejar tareas tan complejas como sintetizar información con un nivel humano de discernimiento? La inclusión de información errónea o de contexto dudoso pone en duda la utilidad de herramientas como AI Overview para los usuarios que buscan respuestas confiables y rápidas.

La importancia del juicio humano

En wwwhatsnew.com creemos que, aunque la IA puede ser una herramienta poderosa, debe complementarse con supervisión humana. Los motores de búsqueda y los sistemas de IA no solo deben priorizar la rapidez en la entrega de resultados, sino también garantizar la calidad y la exactitud de la información proporcionada. Esto es especialmente crucial en un mundo donde las decisiones rápidas pueden tener un impacto significativo, desde la elección de productos hasta la formación de opiniones sobre temas importantes.

Una posible solución podría ser el desarrollo de algoritmos que evalúen la credibilidad de las fuentes con mayor precisión, utilizando datos históricos sobre la fiabilidad de un medio o contexto textual para identificar si un contenido es satírico o ficticio.

Google ha liderado el campo de la innovación tecnológica durante décadas, pero los recientes deslices de su IA subrayan la necesidad de mejorar el enfoque hacia la gestión de información. La IA es como un aprendiz entusiasta que necesita guía constante para evitar errores catastróficos. En este sentido, los usuarios también deben adoptar una actitud crítica y confirmar datos cuando se enfrenten a información proporcionada por sistemas automatizados.

Desde wwwhatsnew.com, recomendamos mantener una mirada reflexiva sobre el desarrollo de estas tecnologías, evaluando sus beneficios y limitaciones. La evolución de la IA es emocionante, pero también requiere responsabilidad por parte de quienes la diseñan y la implementan.