La proliferación de imágenes generadas por inteligencia artificial plantea preguntas éticas y técnicas. ¿Cómo podemos saber si una imagen ha sido creada por una máquina o un humano? Google ofrece una respuesta con su nueva herramienta, SynthID.

La respuesta de Google: SynthID

¿Qué es SynthID?

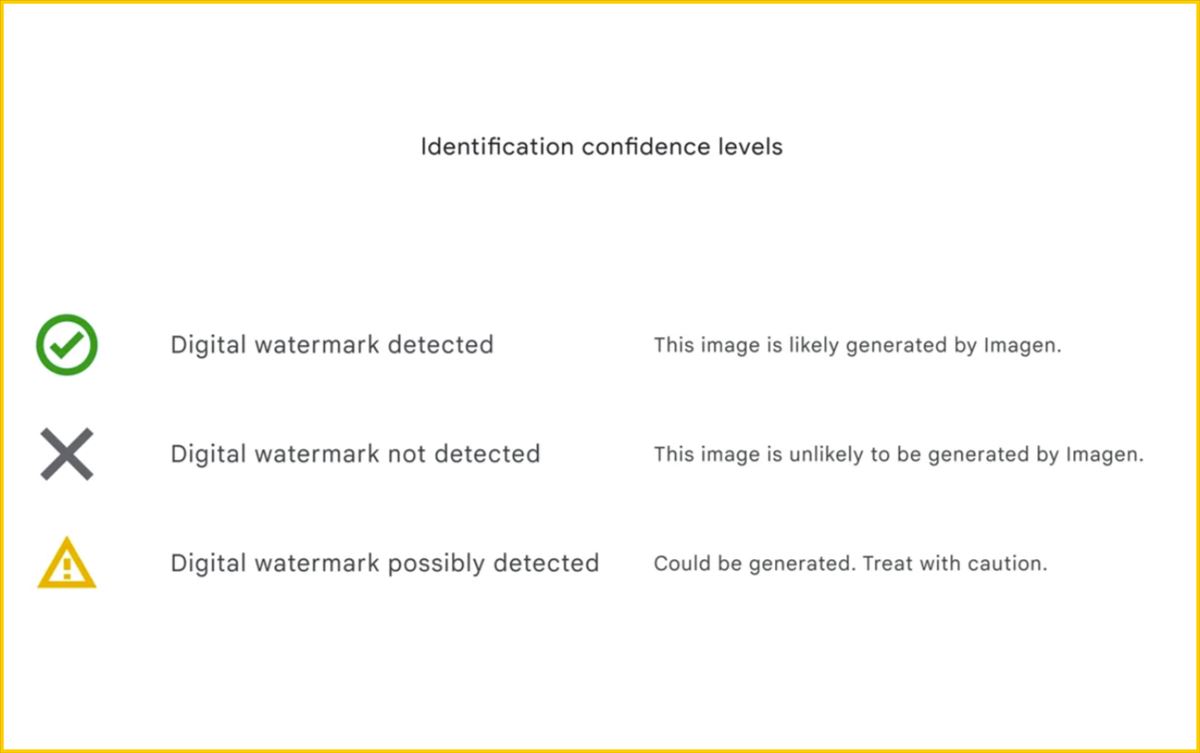

SynthID es una herramienta desarrollada por Google DeepMind que tiene como objetivo marcar imágenes generadas por IA de una manera casi invisible para el ojo humano, pero fácilmente detectable por algoritmos especializados.

Cómo funciona

La marca de agua se incrusta en los píxeles de la imagen. Aunque los detalles técnicos son escasos para evitar su explotación, la marca es robusta a transformaciones como el recorte y el redimensionamiento.

El contexto más amplio: Deepfakes y elecciones

La necesidad de una herramienta como SynthID se vuelve más apremiante en el contexto de las elecciones y la proliferación de deepfakes. Demis Hassabis, CEO de Google DeepMind, subraya la importancia de identificar y detectar imágenes generadas por IA, especialmente con las elecciones de 2024 en el horizonte.

Aplicaciones más allá de la política

Publicidad y Retail

Thomas Kurian, CEO de Google Cloud, señala que la herramienta también tiene aplicaciones en publicidad y retail. Por ejemplo, podría usarse para verificar la autenticidad de imágenes en anuncios o descripciones de productos.

Competencia y estándares en la industria

Google no está solo en esta empresa. Otras compañías como Meta y OpenAI también están trabajando en tecnologías similares, incluido un protocolo llamado C2PA que utiliza metadatos criptográficos.

Integración en productos de Google

Se espera que SynthID se integre en otros productos de Google, como Slides y Docs, y podría incluso ofrecerse como una extensión de Chrome.

Desafíos y futuro

La efectividad de SynthID aún debe probarse en el mundo real. Además, su lanzamiento probablemente iniciará una carrera armamentista con hackers buscando formas de eludir el sistema.

Si bien SynthID representa un paso adelante, la verdadera prueba será su capacidad para adaptarse y evolucionar en respuesta a nuevas formas de ataques y transformaciones. No es una bala de plata para el problema de los deepfakes, pero podría ser un componente crucial en una estrategia más amplia para garantizar la autenticidad en la era digital. Por otro lado, debería incluirse en todos los sistemas de generación de imágenes, y eso es algo que no está claro.

Más información en YouTube