China ha amenazado formalmente a la Unión Europea con represalias amplias si una nueva ley de ciberseguridad acaba excluyendo a Huawei, ZTE y otras compañías chinas de las infraestructuras críticas europeas. Lo cuenta Ana-Maria Stanciuc en TheNextWeb a partir de un reportaje del South China Morning Post. El Ministerio de Comercio chino (MOFCOM) entregó el pasado 17 de abril a la Comisión Europea un documento de 30 páginas en el que advierte explícitamente que Pekín está dispuesto a invocar su Ley de Comercio Exterior y las Regulaciones de Seguridad de la Cadena de Suministro del Consejo de Estado, marcos legales que permiten restringir comercio, investigar entidades extranjeras e imponer prohibiciones recíprocas a compañías europeas si las firmas chinas reciben lo que China considera «trato discriminatorio». La portavoz de MOFCOM, He Yongqian, confirmó la entrega del documento en una rueda de prensa el 24 de abril. Continúa leyendo «China amenaza a la UE con represalias si Huawei y ZTE quedan fuera de las redes europeas: Pekín invocará su Ley de Comercio Exterior si Bruselas formaliza la exclusión»

Trucos de Excel avanzado que la mayoría desconoce y que ahorran horas de trabajo

Excel sigue siendo la herramienta de hojas de cálculo más utilizada del mundo, con más de 750 millones de usuarios activos en 2026, pero la inmensa mayoría apenas aprovecha un 15-20 % de sus funciones. Después de más de 18 años formando a equipos en productividad ofimática, puedo asegurar que dominar una docena de funciones avanzadas marca la diferencia entre perder tres horas en un informe y terminarlo en 30 minutos. Continúa leyendo «Trucos de Excel avanzado que la mayoría desconoce y que ahorran horas de trabajo»

DeepSeek V4 llega con seis meses de retraso, sin multimodalidad y reconociendo que va detrás del estado del arte: el héroe chino tiene pies de barro

DeepSeek ha publicado este 29 de abril su modelo V4 bajo licencia MIT, con mejoras notables en código y arquitectura diseñada para chips chinos. Lo cubre Javier Lacort en Xataka. La compañía también ha admitido, en su propio informe técnico, que va de tres a seis meses por detrás de los modelos occidentales punteros. Para un laboratorio que en enero de 2025 cambió la narrativa global de la IA con su modelo R1 (sacudió los mercados, cuestionó la lógica de las valoraciones tecnológicas estadounidenses y convenció a medio mundo de que China podía competir en la frontera de la IA a una fracción del coste), eso es mucho más que un matiz. Continúa leyendo «DeepSeek V4 llega con seis meses de retraso, sin multimodalidad y reconociendo que va detrás del estado del arte: el héroe chino tiene pies de barro»

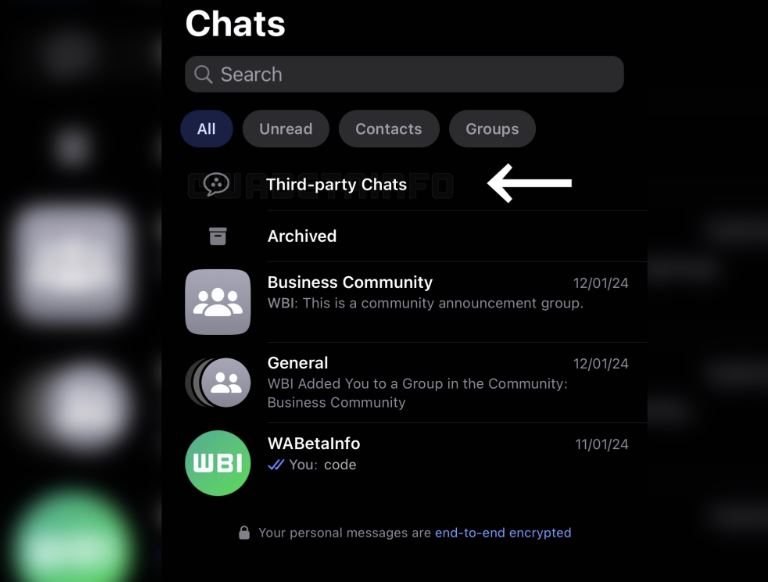

Signal vs Telegram vs WhatsApp: comparativa de seguridad, privacidad y funcionalidades en 2026

WhatsApp tiene 2.000 millones de usuarios activos mensuales. Telegram, 900 millones. Signal, 50 millones. Y aunque parezca que la elección de mensajería es una cuestión de preferencia personal, la realidad es que cada app trata tus datos, tu privacidad y tu seguridad de forma radicalmente diferente. La mayoría de personas usan WhatsApp porque «todos están ahí», sin cuestionarse qué pasa con sus mensajes, metadatos y contactos. Este artículo te da la información para que tomes esa decisión con conocimiento de causa. Continúa leyendo «Signal vs Telegram vs WhatsApp: comparativa de seguridad, privacidad y funcionalidades en 2026»

Google Photos copia el armario virtual de Cher en «Clueless»: IA convierte tu galería en vestidor digital con probador virtual y mood boards

Google Photos ha anunciado este 29 de abril una nueva función con IA que convierte las fotos de tus prendas en un armario digital donde puedes crear nuevos outfits y probártelos virtualmente. Sarah Perez lo cubre en TechCrunch a partir del anuncio oficial de Google. La inspiración explícita es el armario virtual de Cher en Clueless (1995), aquella escena icónica en la que la protagonista combinaba conjuntos en un ordenador antes de elegir la ropa del día. Treinta años después, Google promete que cualquier usuario podrá tener algo parecido en el bolsillo gracias a IA generativa. Continúa leyendo «Google Photos copia el armario virtual de Cher en «Clueless»: IA convierte tu galería en vestidor digital con probador virtual y mood boards»

Tecnología para dormir mejor: lo que funciona, lo que no, y lo que la ciencia dice sobre apps, wearables y gadgets del sueño

Dormimos una media de 6 horas y 49 minutos por noche en España, 37 minutos menos que hace 20 años según la SES (Sociedad Española del Sueño). El 48% de los adultos españoles no duerme lo suficiente. Y alrededor de este problema ha crecido una industria de 400.000 millones de dólares globales (la «sleep economy») que vende desde colchones inteligentes de 3.000 € hasta apps de sonidos de lluvia de 5 €/mes.

La pregunta incómoda que la industria no quiere que hagas: ¿cuánto de esto funciona de verdad y cuánto es marketing disfrazado de ciencia? He probado decenas de herramientas y gadgets para el sueño durante los últimos 4 años, motivado por un problema de insomnio que arrastré durante toda la pandemia. Esto es lo que aprendí. Continúa leyendo «Tecnología para dormir mejor: lo que funciona, lo que no, y lo que la ciencia dice sobre apps, wearables y gadgets del sueño»

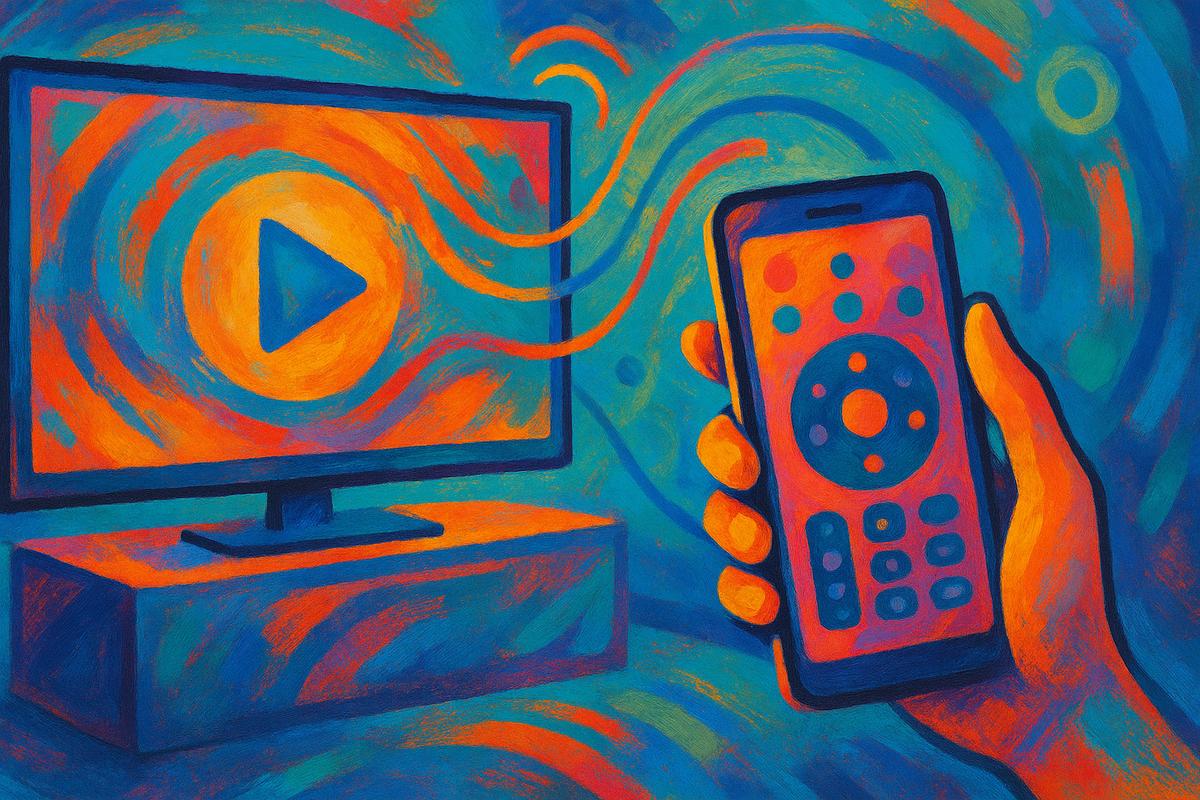

Google TV mete Nano Banana, Veo y la fila de YouTube Shorts en el salón: la tele deja de ser un reproductor para convertirse en lienzo y feed personalizado

Google ha anunciado este 29 de abril una nueva oleada de funciones para Google TV. Lo cuentan TechCrunch, The Verge, Android Authority y 9to5google. Hay tres novedades importantes: el botón «Create» dentro de la pestaña Gemini, que da acceso a Nano Banana (generación y edición de imágenes por voz) y Veo (generación de vídeo); las novedades de Google Photos en Google TV (búsqueda Gemini, función «Remix» con estilos artísticos, «Dynamic Slideshows»); y una nueva fila «Short videos for you» en la pantalla de inicio que llegará este verano con contenido de YouTube Shorts. El primer despliegue empieza hoy en televisores TCL con Gemini en Estados Unidos, con expansión a más dispositivos en los siguientes meses. Continúa leyendo «Google TV mete Nano Banana, Veo y la fila de YouTube Shorts en el salón: la tele deja de ser un reproductor para convertirse en lienzo y feed personalizado»

Drones en 2026: qué puedes hacer (legalmente), qué drone comprar y la normativa que necesitas conocer en España

Los drones han pasado de juguete de entusiastas a herramienta profesional y creativa en menos de una década. DJI domina el mercado con más del 70% de cuota global. Los precios han bajado drásticamente: el DJI Mini 4 Pro, con cámara 4K, sensores anticolisión y 34 minutos de vuelo, cuesta 799 €. El DJI Neo, un drone de 135 g que sigue tu movimiento de forma autónoma, cuesta solo 199 €. Y la normativa europea ha madurado lo suficiente para que un ciudadano responsable pueda volar un drone de forma legal y segura.

He usado drones para fotografía y vídeo durante los últimos 5 años, y lo que más me sorprende es cuánta gente compra un drone sin conocer la normativa y se arriesga a multas de hasta 225.000 € por volar donde no debe. Este artículo es la guía que me habría ahorrado problemas al empezar. Continúa leyendo «Drones en 2026: qué puedes hacer (legalmente), qué drone comprar y la normativa que necesitas conocer en España»

GitHub Copilot acaba con la suscripción plana: a partir del 1 de junio se paga por tokens en todos los planes mientras los modelos chinos siguen abaratando precios

GitHub ha confirmado oficialmente que el 1 de junio de 2026 todos los planes de Copilot pasan a facturación basada en uso. Lo cubre Antonio Vallejo en Xataka y The Decoder a partir del anuncio en el blog oficial de GitHub. La compañía sustituye los Premium Request Units por una nueva unidad llamada GitHub AI Credits: 1 AI Credit equivale a 0,01 dólares (un centavo) y se consume según los tokens (input, output, cached) que use cada interacción, valorados según las tarifas de API publicadas para cada modelo. Los precios base de los planes no cambian: Copilot Pro sigue en 10 dólares al mes, Pro+ en 39, Business en 19 dólares por usuario y Enterprise en 39 dólares por usuario. Cada plan incluye créditos equivalentes a su precio (un usuario Pro recibe 10 dólares en créditos mensuales), y a partir de ahí, el consumo lo decides tú o lo limita tu administrador. Continúa leyendo «GitHub Copilot acaba con la suscripción plana: a partir del 1 de junio se paga por tokens en todos los planes mientras los modelos chinos siguen abaratando precios»

Fibra óptica en España: qué velocidad necesitas de verdad, cómo funciona y cómo elegir operador sin pagar de más

España es el país europeo con mayor despliegue de fibra óptica: más del 94% de la población tiene cobertura FTTH (Fiber To The Home) según la CNMC (2025), muy por delante de Alemania (28%), Francia (70%) o Reino Unido (52%). Y sin embargo, la mayoría de hogares españoles contratan más velocidad de la que necesitan, porque los operadores te venden 1 Gbps como si fuera un Ferrari cuando la mayoría conduce un utilitario. Continúa leyendo «Fibra óptica en España: qué velocidad necesitas de verdad, cómo funciona y cómo elegir operador sin pagar de más»