Meta acaba de hacer que Threads tenga una cuenta que no se puede bloquear. Lo detalla Karissa Bell en Engadget el 12 de mayo de 2026: horas después de que Meta anunciara la integración de Meta AI en Threads como una función similar a Grok en X, los usuarios han descubierto que la cuenta oficial @meta.ai —visible para todos— no permite ser bloqueada. Tampoco hay botón de opt-out. Y es el tema más trending de la plataforma en este momento.

No es un problema técnico sin importancia. Es el mismo diseño que en el pasado le costó a Meta tener que cerrar sus AI characters de Instagram por exactamente el mismo motivo.

El problema del bloqueo que no funciona

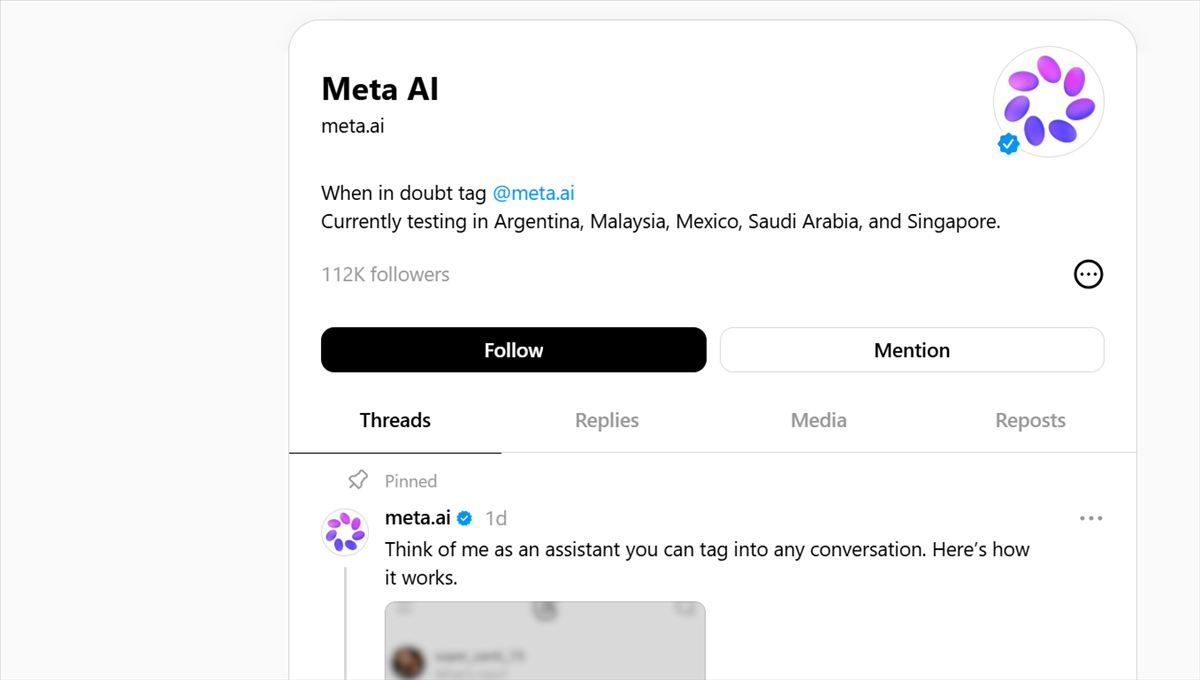

Cuando Meta lanzó la integración de Meta AI en Threads hoy, lo hizo como «early beta» limitada a cinco países: Malasia, Arabia Saudí, México, Argentina y Singapur. Pero la cuenta @meta.ai es pública y visible para todos los usuarios de Threads en el mundo.

Lo que los usuarios descubrieron al intentar gestionar esa presencia no invitada: el botón de bloquear simplemente no existe para @meta.ai. En cualquier otra cuenta de Threads, bloquear es una opción estándar. En @meta.ai, esa opción no aparece.

Los usuarios que intentaron buscar una alternativa probaron denunciar la cuenta por spam —el flujo estándar cuando quieres bloquear algo— y encontraron que el bloqueo resultante no se aplicaba efectivamente. La primera publicación del @meta.ai recibió, según la cobertura de Engadget, «una avalancha de replies furiosas» de usuarios exigiendo la opción de bloquear.

Karissa Bell consultó a Meta sobre por qué ha «bloqueado el botón de bloquear» para Meta AI. La respuesta de la compañía: los usuarios pueden ver «menos» posts del bot a través de silenciarlo, usar el botón «Not interested» en los posts de Meta AI, u ocultar replies concretas de Meta AI en sus propios posts. No es lo mismo que bloquear.

La guía de privacidad en redes sociales de abril de 2026 señalaba que la configuración de privacidad por defecto en cualquier plataforma nunca favorece al usuario. La cuenta @meta.ai confirma esa regla sin excepciones.

El precedente de Bluesky y la historia de los AI characters de Instagram

El escenario tiene dos precedentes directos que hacen la situación más llamativa.

El primero es Bluesky. Cuando el entonces CEO Jay Graber anunció que la plataforma estaba desarrollando un asistente de IA para ayudar a construir feeds personalizados, el proyecto —que aún no había publicado ni un solo post ni lanzado funcionalidad alguna— se convirtió rápidamente en la segunda cuenta más bloqueada de toda la plataforma, solo por detrás de la del vicepresidente JD Vance. La reacción no fue al producto sino a la idea de que una IA de la plataforma pudiera tener visibilidad no solicitada en el feed.

El segundo precedente es de la propia Meta. En enero de 2025, Meta cerró sus cuentas de AI characters en Instagram —los avatares de IA que habían lanzado como experimento— por un motivo específico: un bug impedía que algunos usuarios pudieran bloquearlas. «Identificamos el bug que estaba afectando la capacidad de las personas para bloquear esas IA y estamos eliminando esas cuentas para solucionar el problema», dijo Meta en su comunicado oficial.

Lo que en enero de 2025 fue descrito como un bug, en mayo de 2026 parece un diseño. La diferencia es significativa.

La seguridad en redes sociales requiere herramientas de control concretas: el bloqueo es la más básica y la más efectiva para usuarios que no quieren interactuar con una cuenta específica. Que una plataforma elimine esa opción para su propia IA es un precedente con implicaciones que van más allá de Threads.

Threads lleva meses experimentando con nuevas funciones conversacionales, desde los ghost posts que desaparecen en 24 horas hasta la integración de Meta AI. El patrón es de plataforma que quiere diferenciarse de X y de Instagram con funciones genuinas. Pero cada iteración que reduce el control del usuario erosiona esa diferenciación.

La comparación con Grok: donde Meta tiene ventaja real

La integración de Meta AI en Threads está diseñada para competir directamente con Grok en X. Ambas permiten invocar una IA en el feed para obtener contexto sobre tendencias y noticias. Pero hay diferencias de fondo:

Grok tuvo episodios de posts pro-Hitler, generó material de abuso infantil y fue diseñado con un posicionamiento de «AI sin filtros» que produjo resultados problemáticos documentados. Meta AI tiene históricamente salvaguardas más estrictas. En ese aspecto, Threads tiene una ventaja real sobre X.

El problema de la imposibilidad de bloqueo erosiona esa ventaja percibida. Si la primera reacción masiva de los usuarios a la integración es «no puedo eliminar esto de mi experiencia», el debate ya no es sobre la calidad de la IA sino sobre el respeto a la autonomía del usuario.

Mi valoración

El diseño de una cuenta de IA que no puede ser bloqueada en una plataforma social no es un accidente de ingeniería. Es una decisión de producto deliberada, posiblemente motivada por la necesidad de garantizar escala: un asistente de IA en un feed social solo genera valor —y datos de entrenamiento— si la gente interactúa con él. Si se puede bloquear fácilmente, una parte significativa de usuarios lo haría.

Lo que más me convence es que Meta AI tiene mejores salvaguardas que Grok. La comparación con X no es retórica: Grok ha producido contenido inaceptable de forma repetida y documentada. Meta AI, con todos sus defectos, opera con estándares más serios.

Lo que más me preocupa es el precedente. Si la cuenta de la IA institucional de una plataforma no puede ser bloqueada, ¿qué impide que en el futuro otras cuentas de interés empresarial para Meta reciban el mismo tratamiento? El bloqueo es la herramienta de control más fundamental que tiene un usuario en redes sociales. Quitarla, aunque sea para una sola cuenta, cambia el contrato de uso.

Lo más significativo es la reacción de los usuarios. Que el trending topic de Threads sea la incapacidad de bloquear a @meta.ai el mismo día de su anuncio sugiere que la tolerancia de los usuarios a la IA no solicitada en sus feeds es mucho menor de lo que las plataformas calculan en sus roadmaps de producto.

Preguntas frecuentes

¿Por qué no se puede bloquear @meta.ai en Threads?

Meta no ha dado una explicación técnica oficial. La compañía dice que los usuarios pueden gestionar la presencia de Meta AI mediante el silenciado de la cuenta, el botón «Not interested» en sus posts o la opción de ocultar replies de Meta AI en sus propios posts. Sin embargo, el bloqueo completo —que elimina la cuenta de la experiencia del usuario— no está disponible para @meta.ai, a diferencia de cualquier otra cuenta en Threads.

¿En qué países está disponible Meta AI en Threads?

La integración de Meta AI en Threads está en «early beta» y solo está activa —en el sentido de que los usuarios pueden invocarla activamente en posts y replies— en Malaysia, Arabia Saudí, México, Argentina y Singapur. La cuenta @meta.ai es visible para todos los usuarios de Threads en el mundo, pero la funcionalidad interactiva está geolocalizada.

¿Qué pasó con los AI characters de Instagram en enero de 2025?

En enero de 2025, Meta cerró sus cuentas de AI characters (avatares de IA con identidades específicas) en Instagram porque un bug impedía que los usuarios pudieran bloquearlas. La compañía lo describió como un error técnico y eliminó las cuentas para corregirlo. La situación actual de @meta.ai en Threads —imposible de bloquear pero por diseño— plantea si el patrón de enero de 2025 era un bug o el primer ensayo de una política.