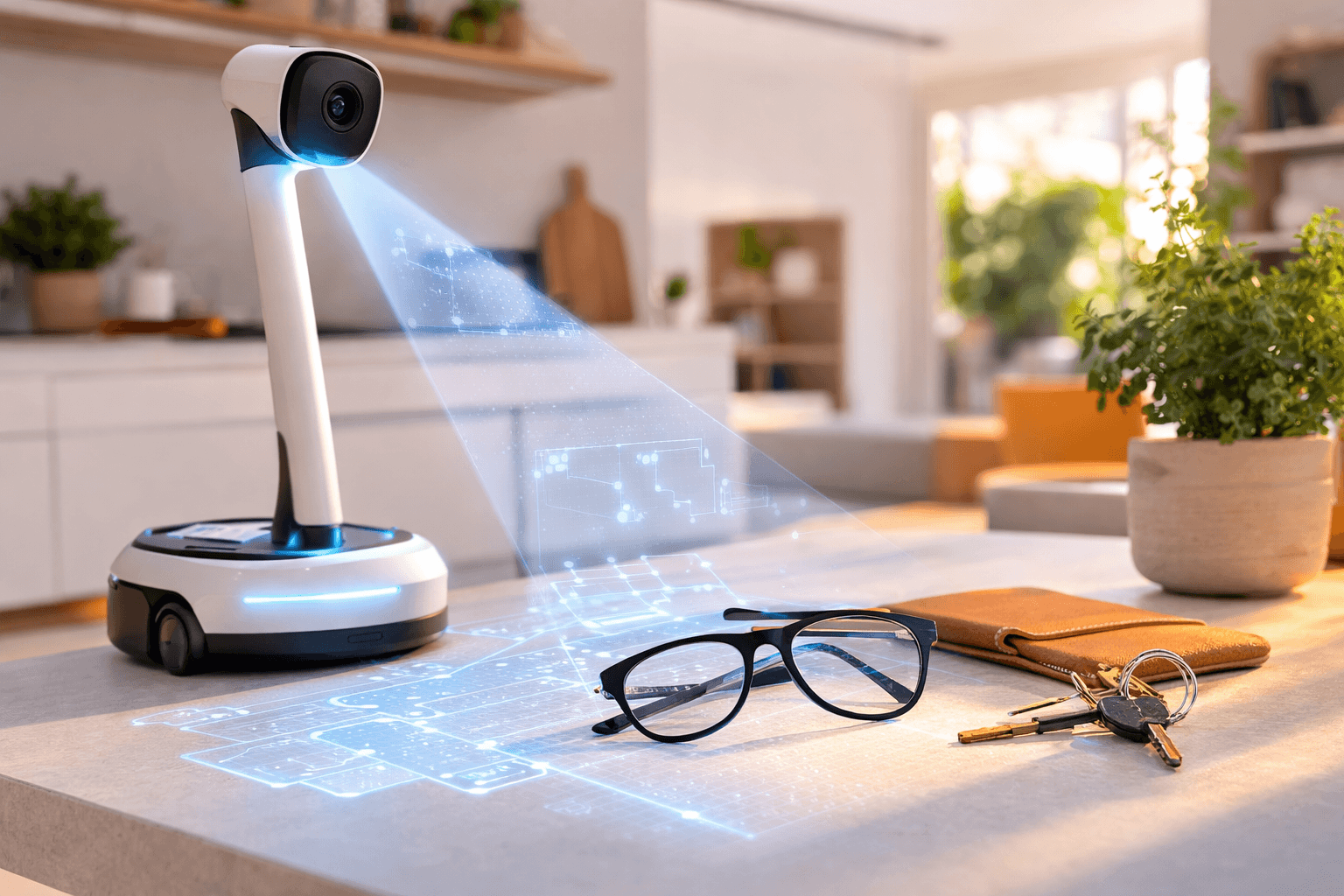

Perder unas gafas en la cocina suele ser un drama doméstico pequeño pero persistente: miras la encimera, revisas la mesa, apartas una servilleta, vuelves a mirar el mismo sitio como si el objeto pudiera materializarse por vergüenza. Esa escena cotidiana es el tipo de problema que un equipo de la Technical University of Munich (TUM) quiere atacar con una idea concreta: un robot de búsqueda que combina mapas 3D del entorno con conocimiento extraído de internet para decidir dónde tiene más sentido mirar primero.

La propuesta, presentada por el grupo de la profesora Angela Schoellig en el TUM Learning Systems and Robotics Lab, se centra en algo que en robótica parece simple hasta que intentas implementarlo: que una máquina no solo “vea” una habitación, sino que la entienda como un humano la usa. La información se ha difundido a través de TechXplore/Science X y se describe en un artículo científico publicado en IEEE Robotics and Automation Letters, firmado por Benjamin Bogenberger y colaboradores.

El “palo con ruedas” que mira como si estuviera tomando nota

El robot no es humanoide ni pretende serlo. Se describe como una especie de palo de escoba sobre ruedas, con una cámara en la parte superior. Esa elección estética es casi una declaración de intenciones: lo importante no es la forma, sino el método. La cámara captura imágenes aparentemente normales, en dos dimensiones, pero con un ingrediente crucial: cada píxel lleva información de profundidad. Con esa pista, el sistema reconstruye un mapa tridimensional del espacio y lo va actualizando mientras se mueve, con precisión a escala de centímetros.

Aquí conviene una metáfora sencilla: imagina que la casa es una ciudad y el robot va levantando un callejero en tiempo real. No dibuja solo las calles, también coloca “etiquetas” en los edificios: mesa, ventana, fregadero, placa de cocina. Ese etiquetado es clave porque el robot no busca en el vacío; busca un objeto que tiene hábitos humanos asociados.

Dos inteligencias artificiales trabajando en tándem

El sistema usa inteligencia artificial en dos frentes. Por un lado, aplica reconocimiento de imágenes para detectar qué objetos aparecen en la escena y cómo se relacionan con el espacio. Por otro, recurre a un modelo de lenguaje para incorporar conocimiento general del mundo, algo parecido al “sentido común” que tú usas sin darte cuenta.

Si te piden encontrar unas gafas, no inspeccionas con la misma intensidad el interior del fregadero que el borde de la mesa. No porque sea imposible que estén ahí, sino porque sabes que no es un lugar típico para dejarlas “un momento”. El equipo de TUM traduce ese tipo de relaciones a un formato utilizable por el robot. Dicho de otra forma: el modelo de lenguaje aporta asociaciones y probabilidades basadas en cómo los humanos solemos comportarnos; el robot convierte eso en decisiones de navegación y en una estrategia de búsqueda.

Prof. Schoellig lo expresa con una idea central: el objetivo es que el robot “comprenda” su entorno, especialmente en espacios que cambian con frecuencia, como una casa o un entorno de trabajo vivo.

Un mapa que no solo dibuja, también apuesta

Una parte llamativa del planteamiento es cómo el robot decide “por dónde empezar”. En su mapa 3D aparecen números que representan probabilidades, recalculadas de forma continua, de que el objeto buscado esté en una zona concreta. Es como si el robot fuese marcando “puntos calientes” en un plano, igual que tú marcas con rotulador mental los sitios donde sueles dejar el móvil cuando entras en casa.

Según los resultados comunicados por el equipo, esta estrategia hace la búsqueda alrededor de un 30% más eficiente que una exploración aleatoria. Esa comparación es importante: no se trata de que el robot encuentre el objeto por arte de magia, sino de que reduce pasos inútiles y prioriza zonas con mayor plausibilidad.

Este tipo de enfoque se encuadra en lo que los autores describen como exploración semántica de “vocabulario abierto”. La idea de “vocabulario abierto” es especialmente práctica: el sistema no está limitado a una lista cerrada de objetos predefinidos, sino que aspira a manejar peticiones más flexibles, como cuando alguien te dice “encuéntrame eso que uso para leer” y tú entiendes que habla de gafas, una lupa o un e-reader según el contexto.

La memoria visual: detectar lo que cambió y sacarle partido

Hay otro ingrediente que suena muy humano: la comparación con el pasado. El robot guarda imágenes anteriores y las contrasta con lo que ve ahora. Si detecta que algo ha cambiado en la cocina, puede inferir que esa novedad es una pista. Por ejemplo, si ayer la mesa estaba despejada y hoy hay una bandeja nueva, esa zona podría convertirse en un candidato fuerte para encontrar un objeto pequeño que se ha extraviado.

El equipo señala una precisión alta al identificar cambios, alrededor del 95% en sus pruebas. En la práctica, esto equivale a la frase que cualquiera ha dicho alguna vez: “si algo ha aparecido aquí, quizá ahí está lo que busco”. El robot intenta formalizar esa intuición con sensores, memoria y probabilidad.

Por qué esto importa más allá de las gafas

La anécdota de las gafas funciona porque es universal, pero la implicación va más lejos. Para robots que se mueven en entornos semi-estáticos —lugares que mantienen una estructura general pero cambian en detalles—, entender el significado de los objetos y sus usos habituales es casi una condición para ser útiles. Piensa en robots de asistencia en el hogar, en entornos de cuidado, o incluso en fábricas donde la distribución puede variar por turnos y tareas.

El aporte de TUM apunta a un fundamento: construir mapas consistentes que integren geometría (dónde están las cosas) con semántica (qué son y cómo se usan). Si un robot solo tuviera geometría, vería superficies y volúmenes sin contexto; si solo tuviera semántica sin mapa, tendría “ideas” pero no sabría moverse con eficacia. La mezcla es lo que permite que la búsqueda no sea un paseo a ciegas.

El siguiente obstáculo: puertas, cajones y el mundo escondido

Hasta ahora, el escenario descrito se centra en lo visible. El siguiente paso que plantea el equipo tiene un punto de realismo inmediato: muchas cosas se pierden donde la cámara no mira, dentro de cajones, detrás de puertas de armario, en muebles cerrados. Resolver eso ya no es solo “ver y razonar”, también es interactuar físicamente con el entorno.

Abrir un armario puede parecer trivial para ti, pero para un robot implica reconocer el tipo de puerta, entender si abre hacia un lado o hacia arriba, localizar el tirador, planear el agarre y aplicar fuerza sin romper nada. Eso exige brazos, manos, control fino y un modelo de seguridad que evite golpes o atrapamientos. El conocimiento de internet puede sugerir “las tazas suelen estar en un armario alto”, pero el robot aún necesita el equivalente mecánico a tus dedos para comprobarlo.

Lo que conviene mirar con lupa: límites, privacidad y expectativas

Este tipo de investigación suele disparar expectativas, así que ayuda ponerla en perspectiva. La eficiencia del 30% y la detección de cambios del 95% son cifras prometedoras, pero pertenecen a condiciones de evaluación concretas. En una casa real hay reflejos, objetos parcialmente ocultos, desorden variable, mascotas que se cruzan, y una iluminación que cambia a lo largo del día. La robustez en “la vida tal cual” es el examen definitivo.

También está el tema de la privacidad. Un sistema que recorre una vivienda con cámara y construye un mapa 3D detallado necesita un manejo cuidadoso de datos, aunque el artículo divulgativo no entre en políticas específicas. En términos prácticos, cualquier aplicación doméstica futura tendría que explicar con claridad dónde se procesan las imágenes, qué se almacena, durante cuánto tiempo y con qué protecciones.

Lo interesante, aun con esas cautelas, es el enfoque: no es un robot que “reconoce objetos” como fin en sí mismo, sino un robot que usa esa capacidad para una tarea delimitada y medible, con una estrategia que imita la manera humana de priorizar.