La inteligencia artificial está entrando en una fase en la que los modelos ya no se cuentan en millones o miles de millones de parámetros, sino en escalas de billones de parámetros, con sistemas cada vez más orientados a agentes que ejecutan tareas completas y se integran en procesos reales de empresas. En ese escenario, el “músculo” que pide la IA no es solo más potencia bruta: también exige baja latencia, uso eficiente del hardware y la capacidad de escalar sin que la infraestructura se convierta en un cuello de botella.

El problema es que crecer “en horizontal” —sumar más nodos a un clúster tradicional— no siempre trae mejoras lineales. A partir de cierto tamaño, muchos entornos empiezan a comportarse como una autopista a la que se le añaden carriles sin mejorar las entradas y salidas: hay más asfalto, sí, pero también más atascos. En entrenamiento de IA, esos “atascos” aparecen cuando la comunicación entre aceleradores se vuelve costosa, baja la utilización del clúster y aumentan las interrupciones durante el entrenamiento. Esto es especialmente delicado cuando el coste de parar y reanudar implica perder tiempo de cómputo muy caro y ralentizar la iteración del modelo.

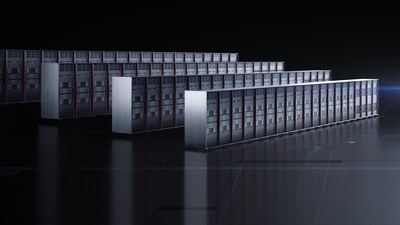

Con ese telón de fondo, Huawei llevó a MWC Barcelona 2026 su visión de cómo empaquetar computación a gran escala: una cartera SuperPoD que agrupa hardware, interconexión y una forma de presentar el conjunto como si fuese una sola máquina lógica.

Qué es un SuperPoD y por qué importa la interconexión UnifiedBus

Para entender un SuperPoD, ayuda una comparación cotidiana. Un centro de datos tradicional se parece a una oficina con muchos equipos repartidos: cada mesa tiene su ordenador, y cuando hace falta colaboración, se envían archivos por red. Un SuperPoD apunta a algo más parecido a una sala de trabajo compartida con una gran pizarra central y pasillos amplios: el diseño prioriza que todos “se hablen” rápido y de forma coordinada, de modo que el conjunto se comporte como una unidad.

En la propuesta presentada, la pieza clave es UnifiedBus, la interconexión que Huawei sitúa en el corazón de estos SuperPoD. La empresa describe una arquitectura “cluster + SuperPoD” pensada para responder a demandas crecientes de cómputo y al mismo tiempo reducir los efectos secundarios típicos de los clústeres masivos: menor aprovechamiento, más latencias y parones durante el entrenamiento. La promesa técnica gira alrededor de tres ideas que suelen marcar la diferencia en IA a gran escala: ancho de banda alto, latencia baja y coordinación de memoria.

Aquí conviene aterrizarlo con un ejemplo sencillo. Si el entrenamiento de un modelo fuese cocinar para un banquete, los aceleradores son los cocineros. Si la cocina es grande, pero el pasillo para traer ingredientes es estrecho, los cocineros acaban esperando. La interconexión es ese pasillo: si se ensancha y se organiza bien el flujo, se cocina sin tiempos muertos. Huawei intenta que UnifiedBus sea ese “pasillo” optimizado para que el trabajo distribuido no pierda ritmo.

Atlas 950 SuperPoD: miles de NPUs como un único “ordenador lógico”

En el escaparate de MWC Barcelona 2026, uno de los protagonistas fue Atlas 950 SuperPoD. Huawei lo plantea como una base para escenarios de entrenamiento e inferencia de IA, con un elemento muy llamativo: la capacidad de conectar hasta 8.192 NPUs mediante UnifiedBus. En la práctica, el objetivo es que esa escala no sea solo un número, sino una plataforma utilizable, con rendimiento estable y comunicación interna eficiente.

La nota técnica menciona direccionamiento de memoria unificado, un concepto que puede sonar abstracto. Llevado a lo cotidiano, es como si en una biblioteca enorme todos los libros siguieran un mismo sistema de catalogación, sin “estanterías privadas” que obliguen a los bibliotecarios a traducir referencias de una sala a otra. En IA, cuando muchos aceleradores comparten el trabajo, coordinar datos, parámetros y estados del entrenamiento se vuelve tan importante como la potencia de cálculo. Un esquema de memoria más coherente puede reducir fricción y ayudar a que el clúster se sienta como una única máquina, no como un conjunto de piezas pegadas.

Huawei también mencionó Atlas 850E dentro de las novedades expuestas, encuadrándolo en el mismo enfoque de SuperPoD y UnifiedBus para cubrir un rango más amplio de casos de uso. El mensaje de fondo es claro: no se trata solo de “tener aceleradores”, sino de ofrecer una infraestructura donde la comunicación interna y la organización del sistema acompañen el crecimiento de los modelos.

TaiShan 950 SuperPoD: un SuperPoD de propósito general para cargas variadas

Otro anuncio destacado fue TaiShan 950 SuperPoD, descrito como el primer SuperPoD de computación de propósito general de la industria. Esta etiqueta es relevante porque, aunque la IA acapare titulares, los centros de datos reales suelen mezclar tareas: bases de datos, virtualización, servicios web, analítica y diferentes niveles de exigencia. Un enfoque de propósito general busca encajar en esa diversidad sin obligar a que todo sea “AI-first”.

En el mismo bloque, Huawei presentó servidores como TaiShan 500 y TaiShan 200, orientados a ofrecer opciones flexibles para cargas de distinta intensidad, desde escenarios exigentes hasta otros más ligeros. La lectura práctica es que la compañía intenta cubrir el “continuo” de necesidades, no solo el extremo de grandes entrenamientos. En términos de operación, eso puede importar tanto como la potencia máxima: muchas organizaciones necesitan escalar con orden, desplegando recursos donde hacen falta y sin sobredimensionar.

Este enfoque también refleja una tensión habitual en infraestructura: lo ideal es tener un único tipo de plataforma para todo, pero la realidad exige modularidad. Si una empresa es como una ciudad, no todo el tráfico son camiones; también hay coches, motos y transporte público. Una oferta que combine computación de propósito general con propuestas específicas de IA apunta a gestionar mejor esa mezcla.

Apertura y ecosistema: openEuler, CANN y el “pegamento” del software

Huawei acompañó el hardware con un discurso centrado en código abierto y colaboración abierta, una dimensión que, en computación de IA, suele ser tan decisiva como los chips. Muchas plataformas fracasan no por falta de rendimiento, sino por falta de herramientas, compatibilidades y comunidad: sin ese “pegamento”, el hardware se queda como un motor potente al que le faltan carreteras.

La compañía destacó su papel en openEuler, comunidad de sistema operativo de código abierto que, según el comunicado, ha escalado rápido entre las comunidades líderes a nivel global. También subrayó que ha abierto por completo CANN, su arquitectura de computación heterogénea, y que pone a disposición componentes de software por capas: bibliotecas de operadores, bibliotecas de aceleración, computación de grafos y lenguajes de programación.

A nivel práctico, esta “desacoplación por capas” puede facilitar que desarrolladores y empresas adopten partes del stack sin quedar atrapados en un único camino. Es parecido a construir con piezas estándar: si un tornillo o una bisagra sigue un formato común, reparas y actualizas sin rehacer el mueble entero. En IA, esa modularidad se traduce en poder ajustar kernels, optimizaciones, runtimes o frameworks con menor fricción.

Huawei citó compatibilidades y apoyos hacia proyectos y comunidades como PyTorch, vLLM, Triton, TileLang y verl, presentándolo como un paso para mejorar accesibilidad y eficiencia de desarrollo. En el terreno de la inferencia y la puesta en producción, esa interoperabilidad pesa mucho: a menudo se decide plataforma por lo bien que se integra con herramientas de entrenamiento, despliegue y optimización que ya usa el equipo.

Qué significa “una nueva opción” en la práctica: oportunidades y preguntas razonables

El mensaje global de Huawei en MWC Barcelona 2026, tal como lo recoge la nota distribuida por PRNewswire, se resume en “crear una nueva opción” para la era de la IA, con una base de computación resiliente y un ecosistema simbiótico. Para organizaciones que buscan alternativas tecnológicas, una propuesta que combine infraestructura de IA a gran escala con un enfoque explícito en open source puede resultar atractiva por dos motivos: rendimiento potencial y margen para construir sin depender de un único proveedor en cada capa.

A la vez, un enfoque responsable invita a mirar más allá del anuncio. En plataformas de clúster masivo, el rendimiento real depende de detalles de implementación, madurez de software, herramientas de observabilidad, experiencia operativa y el tipo de cargas concretas. También pesa la disponibilidad regional, el soporte, la compatibilidad con librerías específicas y el coste total de propiedad. Dicho de forma sencilla: no basta con que el “motor” sea potente; hace falta que el coche tenga mantenimiento, repuestos y un manual claro.

Lo interesante del planteamiento SuperPoD es que reconoce un dolor muy real en IA: escalar no es solo sumar aceleradores, es diseñar comunicación, memoria y software para que el conjunto se comporte con coherencia. Si esa coherencia se materializa, se reduce la sensación de estar coordinando una orquesta enorme sin director, y se pasa a un sistema que “respira” como una sola máquina, incluso cuando por dentro hay miles de piezas trabajando al unísono.