Google ha anunciado un sistema que puede ayudar a agilizar las tareas con el asistente de Google, una plataforma que permitirá programar acciones con solo pulsar un botón.

Se trata de Action Blocks, disponible de momento en fase beta cerrada en Estados Unidos en este enlace.

Lo que pretenden es permitir que las personas que tengan algún tipo de discapacidad puedan realizar tareas con el móvil sin necesidad de tener que navegar entre varios menús. Solo tendrán que pulsar una imagen para que se realicen varias tareas predefinidas en secuencia, siempre con el asistente de Google.

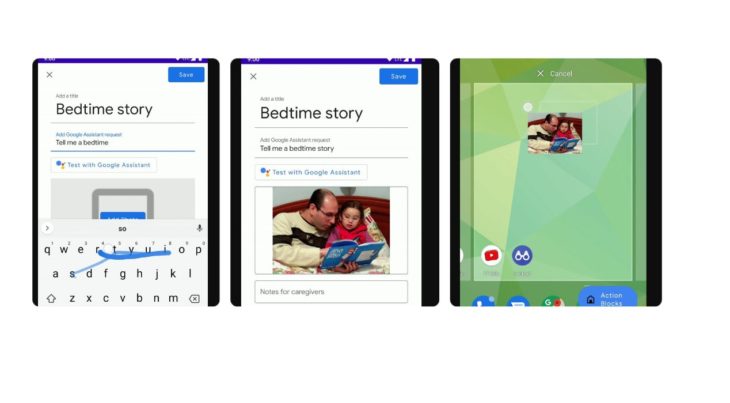

En el ejemplo mostrado tenemos una imagen de un padre contando una historia a su hija. Cuando alguien pulse en dicha imagen, el asistente de Google recibirá la orden «cuéntame una historia» y el teléfono comenzará a hablar como si alguien hubiera accionado al asistente con la voz de forma tradicional.

Son así accesos directos para tareas comunes de varios pasos con la ayuda del Asistente de Google, semejante a los accesos directos en iOS, pero en este caso creado como una característica de accesibilidad para personas con discapacidades cognitivas.

Según una investigación de Google, el 80% de las personas con discapacidades cognitivas severas, como demencia avanzada, autismo o síndrome de Down, no usan teléfonos inteligentes, en parte debido a las barreras que ofrecen los smartphones para este tipo de personas.

Con Action Blocks podemos así definir una secuencia de comandos para el Asistente de Google, por lo que todo lo que el Asistente puede hacer se puede programar usando esta nueva herramienta, sin importar si eso es iniciar una llamada o reproducir un programa de televisión. Una vez que se configura el Bloque de acción, podemos crear un acceso directo con una imagen personalizada en la pantalla de inicio del teléfono.

Aún no sabemos cuando estará disponible para todos, pero estaremos atentos.