El mundo de la inteligencia artificial está avanzando a pasos agigantados, y con estos avances, surge la necesidad imperativa de asegurar que los sistemas de IA sean seguros y confiables. El Reino Unido ha dado un paso significativo en esta dirección con el lanzamiento de una herramienta pionera llamada Inspect. Esta iniciativa, liderada por el recién establecido Instituto de Seguridad de IA del Reino Unido, promete ser un punto de inflexión en la evaluación de la seguridad de la IA. Vamos a desglosar qué hace esta herramienta y por qué podría ser crucial para el futuro de la inteligencia artificial.

¿Qué es Inspect y por qué es importante?

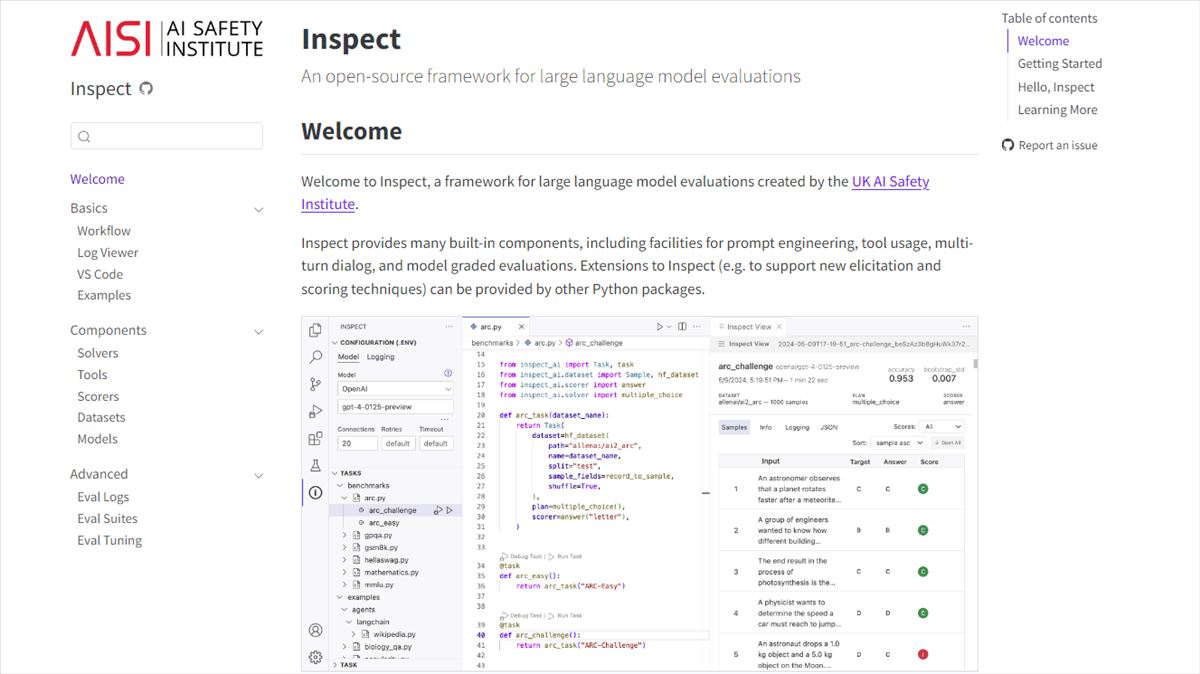

Inspect es una herramienta de código abierto destinada a fortalecer la seguridad en el ámbito de la inteligencia artificial. Su principal objetivo es ofrecer un método estandarizado y accesible para evaluar las capacidades de los modelos de IA. Lo interesante de Inspect es que está bajo la licencia MIT, lo que significa que cualquier persona o entidad puede utilizarla y modificarla según sus necesidades.

La herramienta se estructura en torno a tres componentes principales:

- Conjuntos de datos: Proporcionan las muestras necesarias para realizar las pruebas de evaluación.

- Solucionadores: Se encargan de ejecutar las pruebas de manera efectiva.

- Evaluadores: Analizan los resultados de los solucionadores y los resumen en métricas comprensibles.

Flexibilidad y extensibilidad de Inspect

Uno de los mayores desafíos en el desarrollo de IA es la naturaleza «caja negra» de los modelos más avanzados, donde los detalles de su infraestructura y datos de entrenamiento suelen ser secretos comerciales. Inspect aborda este desafío ofreciendo una plataforma que no solo utiliza las herramientas que vienen incorporadas sino que también permite la integración de paquetes de terceros, principalmente escritos en Python. Esta característica subraya su potencial para adaptarse y extenderse con nuevas técnicas de prueba, fomentando una colaboración y mejora continua dentro de la comunidad global de IA.

Colaboración internacional y comparativas

El lanzamiento de Inspect no ocurre en aislamiento. Se produce en un contexto donde instituciones como el Instituto Nacional de Estándares y Tecnología (NIST) en Estados Unidos también están emprendiendo iniciativas similares. Además, la cooperación internacional se ve reforzada por una asociación entre los Estados Unidos y el Reino Unido para desarrollar conjuntamente pruebas de modelos de IA avanzados. Esta colaboración transatlántica es crucial para establecer estándares y prácticas de seguridad en IA a nivel mundial.

Impacto potencial y futuro de Inspect

La herramienta Inspect tiene el potencial de convertirse en un componente fundamental para los desarrolladores de IA, investigadores y académicos, proporcionando una base sólida para realizar evaluaciones de seguridad de manera eficiente y confiable. La esperanza del Instituto de Seguridad del Reino Unido es que esta herramienta no solo facilite las pruebas de seguridad propias, sino que también inspire y sirva de base para futuras innovaciones y mejoras en la seguridad de la IA.

La IA está evolucionando, y con herramientas como Inspect, estamos un paso más cerca de garantizar que esta evolución sea segura y beneficiosa para todos. Mantenerse al día con estas herramientas y entender cómo se utilizan será esencial para cualquier profesional del sector.

Tenéis más información en www.gov.uk.