Este año nos hemos dado cuenta de cómo va a cambiar el mundo dentro de muy poco. Comienzan a aparecer sistemas de inteligencia artificial capaces de crear imágenes relativamente realistas a partir de texto, y en los últimos meses ya hemos visto algunas demostraciones realmente impresionantes.

Ahora tenemos una nueva opción en Stable Diffusion, con imágenes más realistas que las de DALL-E mini, aunque menos que las de DALL-E. La ventaja es que, al contrario que con las de DALL-E, esto sí se puede probar de forma gratuita en la web.

Stable Diffusion: click aquí y mete un texto (en inglés). Tendrás que probar varias veces y esperar a la cola, ya que hay muchas peticiones.

DALL-E mini: click aquí, el resultado es prácticamente inmediato.

El caso es que he probado los dos sistemas con dos frases diferentes:

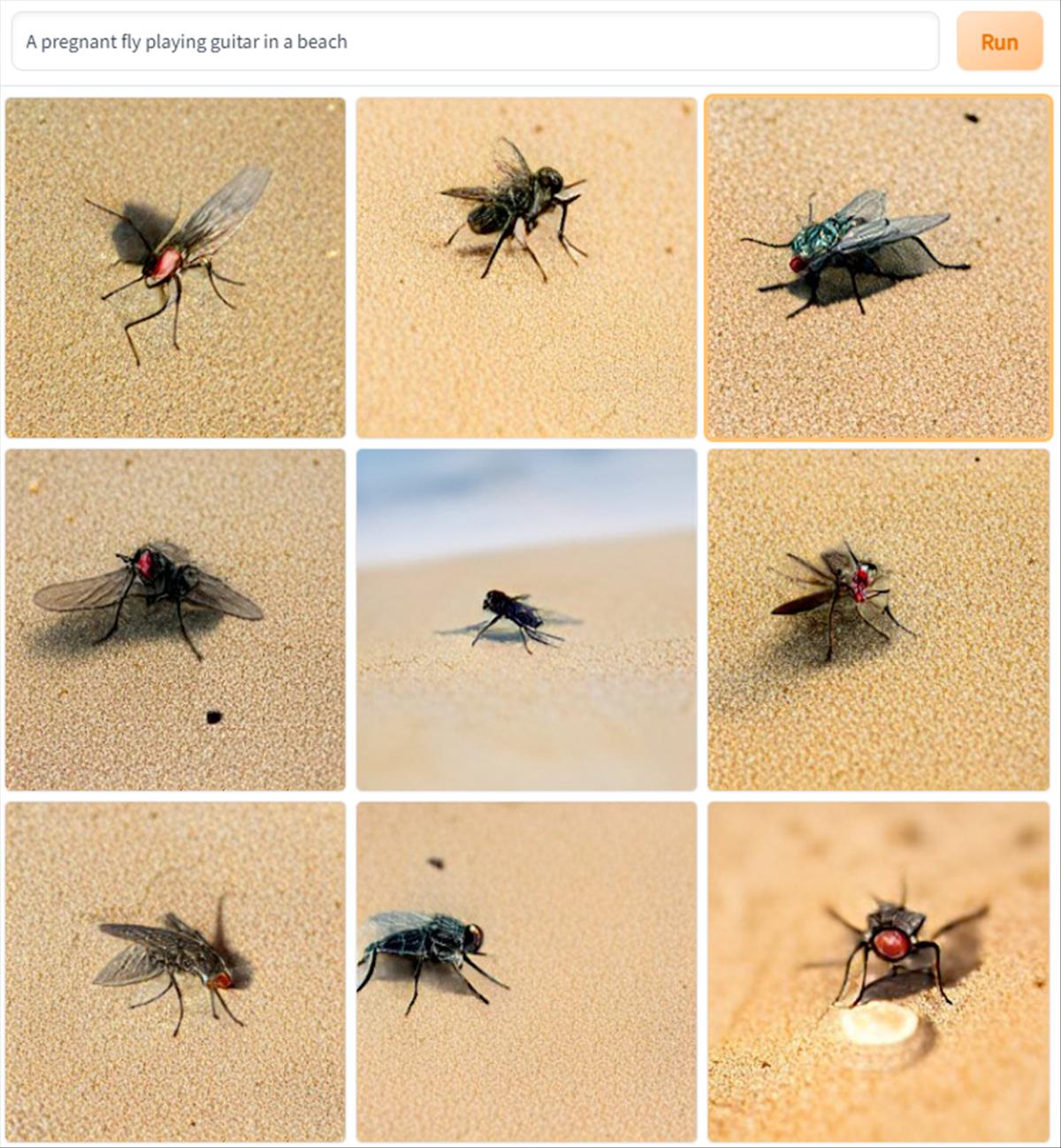

– Dibuja una mosca embarazada tocando la guitarra en una playa.

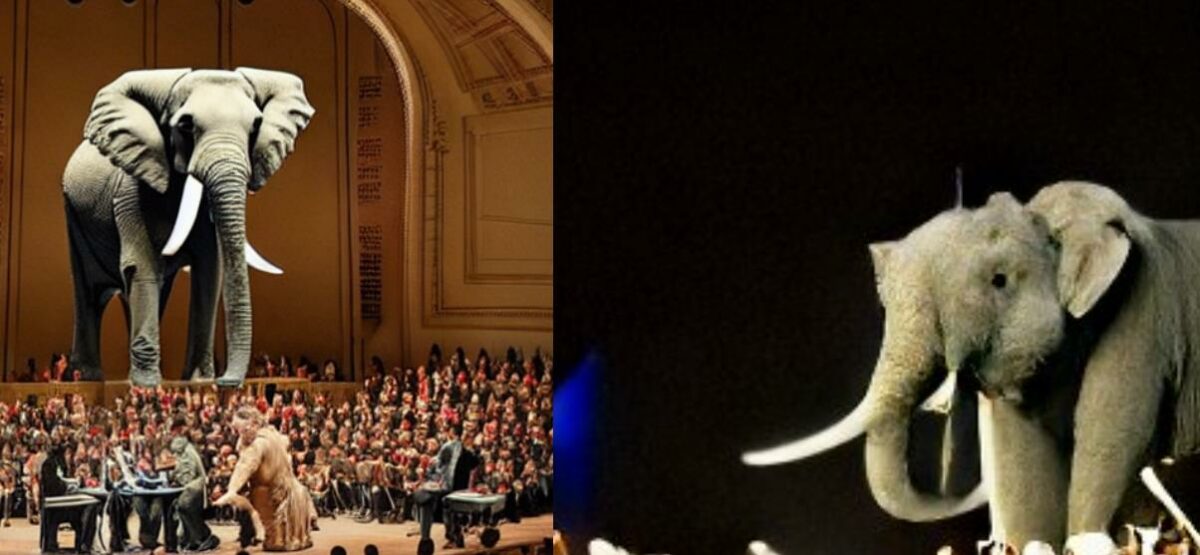

– Un barco y un elefante en un concierto

Aquí tenéis los resultados.

DALL-E mini

Como veis, DALL-E mini ha ignorado la guitarra y el embarazo, al mismo tiempo que mantiene ese estilo abstracto con líneas poco definidas. Son demasiados detalles para ese motor inteligente, por algo es solo la versión «mini» del todopoderoso Dall-E.

En algunos casos se puede ver el barco, en otros no tanto, y el realismo del elefante deja que desear, pero el resultado no es del todo malo si tenemos en cuenta los límites de la aplicación.

Stable Diffusion

Aquí lo que ha ignorado es la mosca, aunque la palabra «fly» también significa «volar», y es posible que se haya líado con el tema. La chica que aparece, tiene ojos grandes de mosca, eso sí, por lo que puede ser alguna referencia oculta.

Aquí el realismo mejora mucho, aunque en algunas fotos pone el barco y en otros el elefante, no se pueden ver bien los dos en la misma sala de concierto.

Aún hay mucho que mejorar, pero está claro que esta tecnología ha llegado para quedarse.