En los últimos tiempos, hemos visto lo que pueden lograr robots impulsados por IA, desde tareas complejas hasta descabelladas, siguiendo diferentes patrones o utilizando conocimiento previo.

Pero DeepMind quiso ir a una zona todavía sin explorar: que puedan realizar tareas sin tener conocimiento previo de ello, ni recibir instrucciones de cómo hacerlo.

Es decir, asignar una tarea y que el robot resuelva cómo hacerlo, con todos los cientos de variantes que pueda implicar:

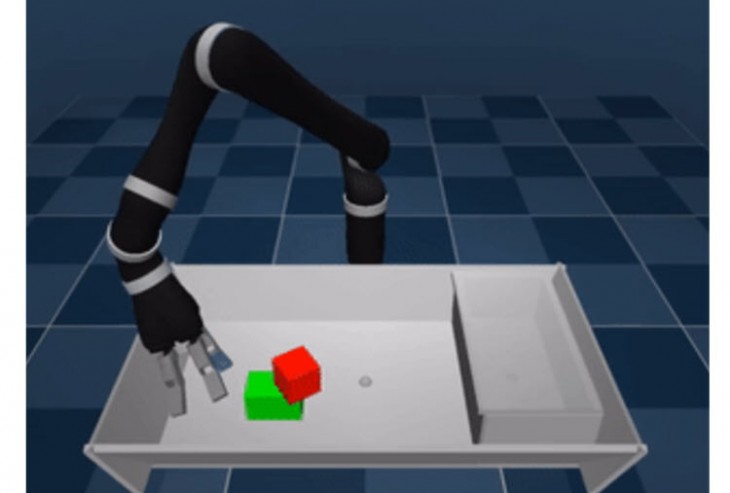

Las tareas de control, como poner en orden una mesa o apilar objetos, requieren que un agente determine cómo, cuándo y dónde coordinar las nueve articulaciones de sus brazos y dedos simulados para moverse correctamente y lograr su objetivo

Por ejemplo, se le asigna una tarea nueva: mover objetos en una caja. Al no brindarle información de cómo completar la tarea, tendrá que explorar su entorno y los recursos que tiene disponible, para saber cómo actuar.

Las pruebas la realizaron con un brazo robótico, asignándole la tarea de colocar los cubos dentro de la caja, y dando una recompensa con cada logro que lo lleve a cumplir con el objetivo. La IA realizó las pruebas primero en un entorno virtual, y después utilizando el brazo robótico.

Podemos ver las pruebas en el siguiente video:

El sistema de recompensa le sirve para evaluar su progreso. Es decir, va aprendiendo, a base de prueba y error, a medida que se adapta al entorno y evalúa sus recursos.

Podemos leer todo el proceso y los aspectos técnicos de este experimento en este informe que comparten DeepMind.